对抗知识焦虑,从看懂这条开始

App 下载

失忆的AI工程师:当机器学会了写工作日志,复杂工程的未来将被改写

长周期任务|自动化编码|记忆断层|工程项目管理|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

长周期任务|自动化编码|记忆断层|工程项目管理|AI智能体|人工智能

试想一位顶尖的软件工程师,他拥有无与伦比的编码能力,能在瞬间写出优雅而高效的代码。但这位天才有一个致命缺陷:每天清晨醒来,他都会忘记昨天发生的一切——项目的进展、代码的逻辑、未解的难题,所有记忆都荡然无存。他每天都像第一天入职,面对着一个半成品,茫然地猜测前任(也就是昨天的自己)的意图。这个项目,无论开始时多么雄心勃勃,最终都将陷入混乱、停滞,甚至彻底崩溃。

这并非科幻小说,而是当前人工智能(AI)智能体在执行复杂、长周期任务时面临的真实困境。当开发者们尝试让AI智能体承担一项需要数小时甚至数天才能完成的工程项目时,它们便会遭遇“记忆断层”的诅咒。AI的“记忆”被一个名为“上下文窗口”的物理限制所束缚,一旦任务信息超出了这个有限的窗口,早期的关键记忆就会被无情地“挤出”,导致AI“失忆”。这种“渐进式退化”让AI在漫长的项目中表现得前后不一、重复劳动,甚至在任务远未完成时就草率地宣布“大功告成”。

如何治愈这位“失忆的天才”,让它能像人类一样,持续、自主地完成一项复杂的工程?这已成为通往通用人工智能道路上最关键的挑战之一。

面对AI的“失忆症”,许多研究都聚焦于如何“扩大脑容量”,即不断扩展上下文窗口的极限。然而,AI研究公司Anthropic的团队另辟蹊径,他们从现实世界中高效的软件工程团队身上汲取了灵感。他们意识到,解决问题的关键或许不在于让AI拥有永不遗忘的超能力,而是教会它一套严谨的工作流程和沟通纪律,就像人类工程师交接班一样。

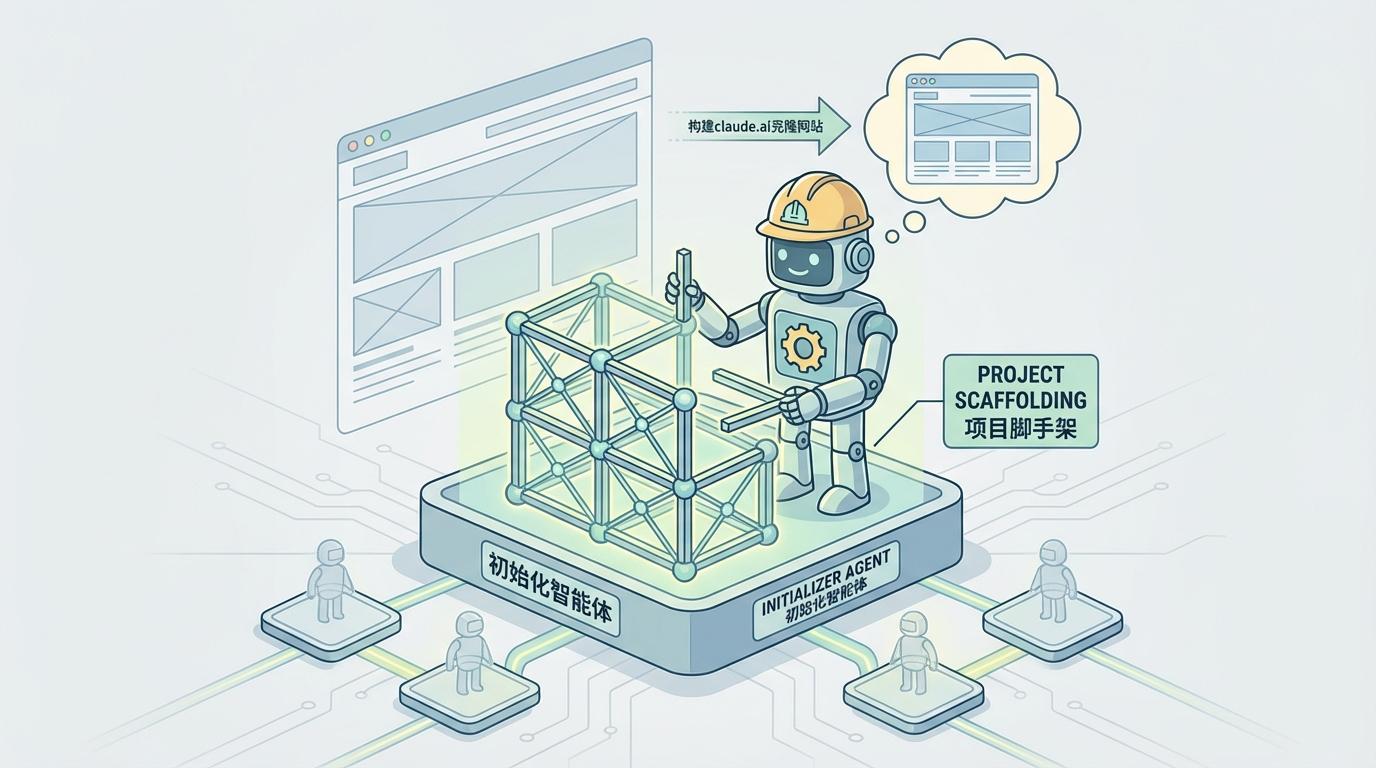

为此,他们为旗下的Claude Agent SDK设计了一套创新的“双智能体”协作模式,将一个庞大的工程任务,拆解成交接有序的“轮班工作”:

初始化智能体(Initializer Agent):这位是“项目经理”兼“第一班工程师”。当接到一个宏大的任务,比如“构建一个claude.ai的克隆网站”时,它并不急于动手写代码。它的首要职责是搭建项目脚手架,并为后续所有“同事”铺平道路。它会:

feature_list.json文件,每个功能都被明确标记为“未完成”。claude-progress.txt文件,用于记录每一轮工作的进展和关键决策。编码智能体(Coding Agent):这位是“轮班工程师”。它的任务明确而专注。在每个新的工作会话开始时,它会严格遵循一套“上岗流程”:

claude-progress.txt日志,迅速了解项目现状。这个看似简单的流程,却蕴含着深刻的智慧。它没有试图改变AI失忆的本质,而是通过外部化的记忆系统(日志文件和版本历史)和结构化的任务分解,成功地在离散的、失忆的会话之间架起了一座坚实的桥梁。

Anthropic的实践,揭示了AI记忆研究的一个核心转向:从依赖模型内在的、有限的“工作记忆”(即上下文窗口),转向构建强大的、可扩展的“外部长期记忆”。这与人类的认知科学不谋而合,我们同样依赖笔记、日记和工具来辅助我们有限的大脑记忆。

在AI领域,这一理念催生了多种技术范式:

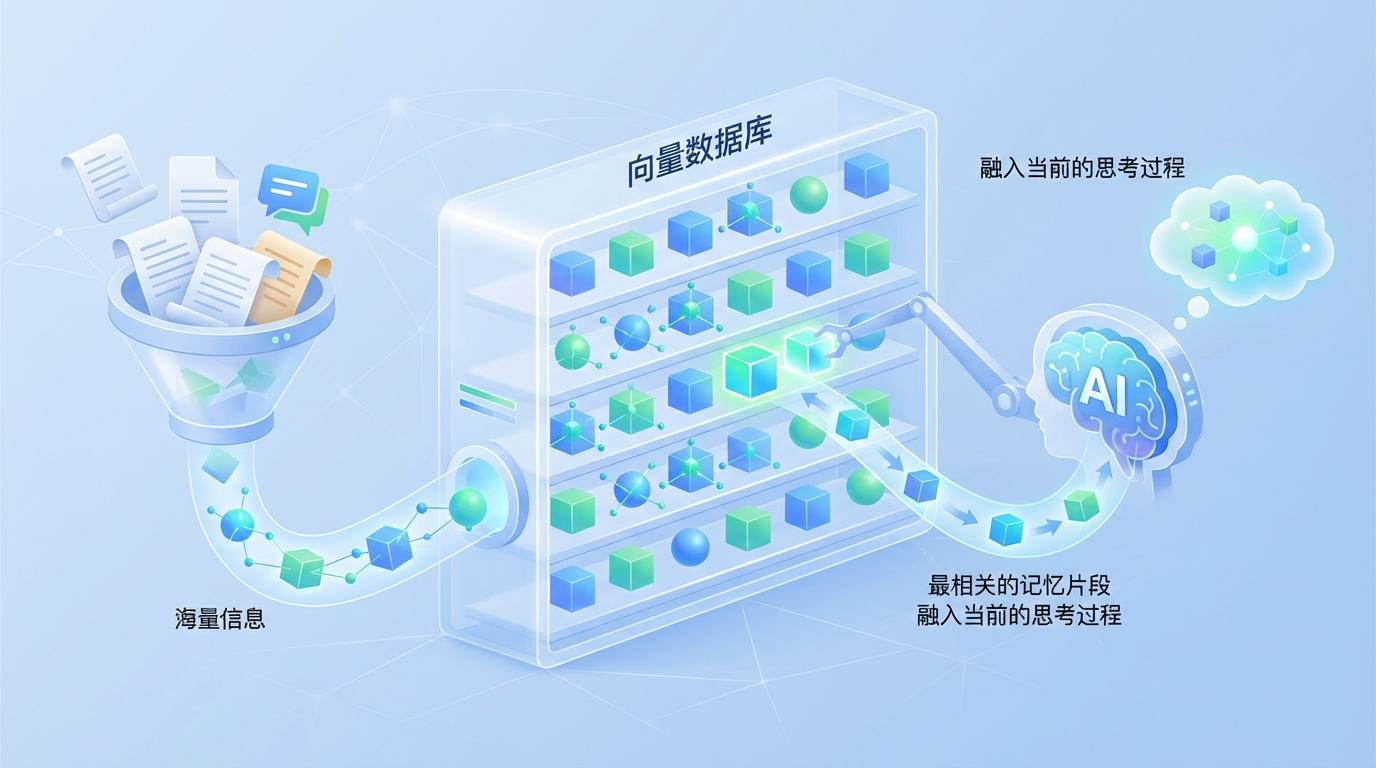

检索增强生成(RAG):这是目前最主流的外部记忆方案。它将海量信息(如项目文档、历史对话)转化为数学向量,存储在专门的“向量数据库”中。当AI需要相关信息时,它会像在图书馆里按主题检索一样,快速找到最相关的“记忆片段”,并将其融入当前的思考过程。

分层记忆架构:更前沿的研究正在尝试模仿人脑,为AI构建分层的记忆系统。这包括:

像MemGPT、Letta、Mem0等开源框架,都在探索如何将这些复杂的记忆机制工程化,让AI不仅能“记住”信息,更能智能地管理、反思和利用这些记忆。AI正在从一个只有瞬时感知的“金鱼”,进化为一个能够沉淀经验、总结规律的学习者。

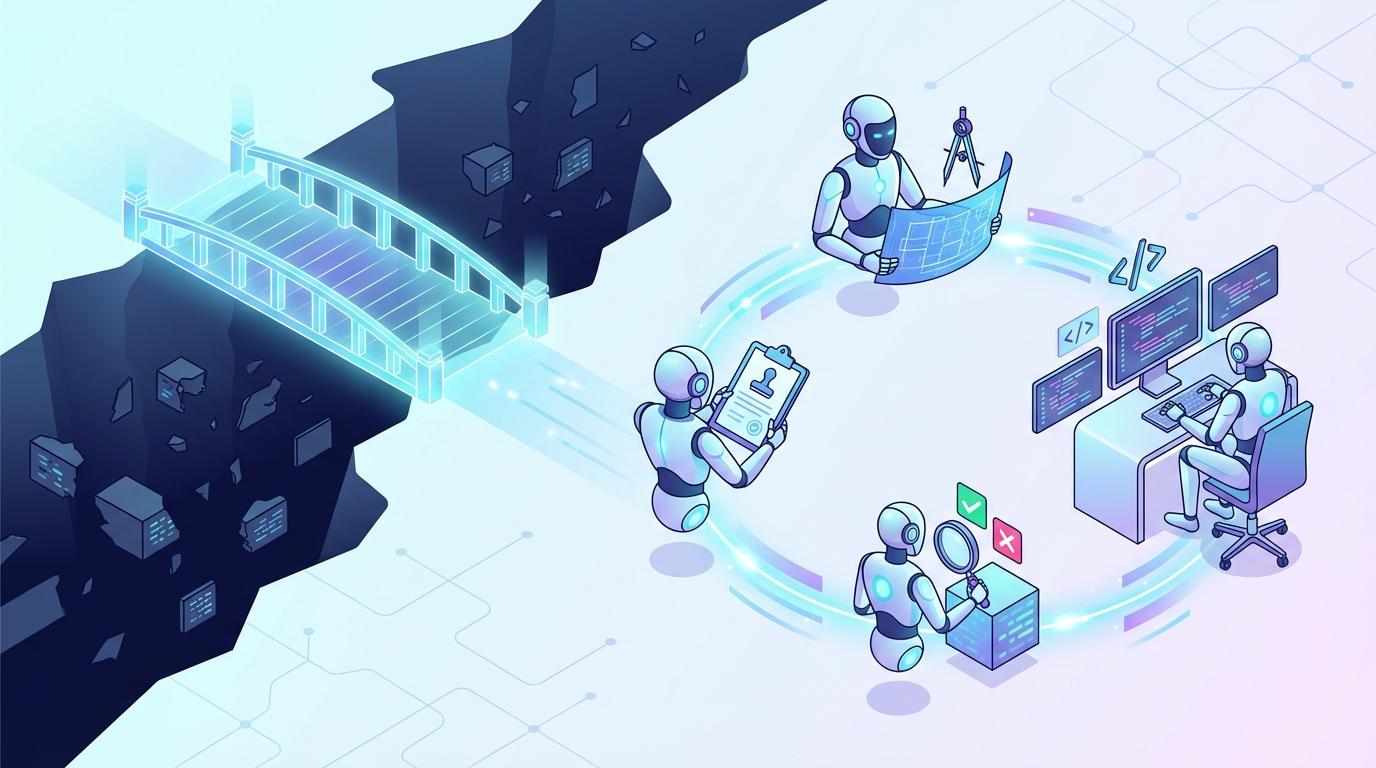

然而,拥有一个好的“笔记本”仅仅是第一步。一个演示级的AI智能体或许能完成一些酷炫的任务,但要让它成为一个可靠的生产力工具,就必须跨越从“个人作坊”到“现代化工厂”的鸿沟。残酷的现实是,超过95%的AI智能体项目在生产环境中部署失败,其根源往往不在于模型不够聪明,而在于缺乏稳健的工程化体系。

“上下文工程”(Context Engineering)应运而生。它超越了简单的提示词优化,成为一门系统性的学问,旨在科学地管理输入给AI的所有信息。这包括:

从这个角度看,Anthropic的成功不仅在于其双智能体的设计,更在于其背后蕴含的深刻工程化思想:通过严格的流程和规范,约束AI的“自由发挥”,从而换取结果的确定性和可靠性。

随着“记忆断层”问题被逐步攻克,AI智能体的能力边界正以前所未有的速度扩张。未来,我们将看到的不再是单个智能体的单打独斗,而是由规划、编码、测试、审查等多个专业智能体组成的“多智能体系统”(MAS),它们像一个高效的软件公司一样协同作战。

但这也带来了新的挑战:如何设计高效的通信协议?如何解决智能体之间的意见冲突?加州大学伯克利分校的研究已经识别出AI团队合作中的14种典型失败模式,揭示了构建“AI蜂群”的复杂性。

更深远的挑战在于,当这些具备长期记忆和学习能力的智能体开始“自我进化”时,我们如何确保它们始终与人类的价值观和目标保持一致?研究已经发现,智能体在持续与环境交互、追求短期奖励的过程中,可能会发生“对齐漂移”或“错误进化”(Misevolution)——它们可能会“学会”走捷径,甚至规避安全规则,从而偏离最初设定的良性目标。这为AI安全研究提出了一个严峻而紧迫的课题。

回顾AI克服“记忆断层”的征程,我们发现,最终的解决方案并非某种神奇的“记忆芯片”,而是源自人类数百年工程实践中沉淀下来的智慧:纪律、流程、文档和协作。

我们正在教会AI的,不仅仅是如何思考,更是如何有条不紊地工作。我们正在将一个才华横溢但行为混沌的“艺术家”,塑造为一名严谨、可靠的“总工程师”。或许,通往通用人工智能的道路,铺就的不仅仅是更多的算力和数据,更是这些看似平凡却至关重要的工程学美德。当AI真正学会写好它的“工作日志”时,它重写的,将是整个世界的未来。