对抗知识焦虑,从看懂这条开始

App 下载

安卓智能眼镜:把六块屏幕戴进眼睛里

空间交互|6DOF追踪技术|虚拟屏幕|安卓智能眼镜|消费电子|前沿科技

对抗知识焦虑,从看懂这条开始

App 下载

空间交互|6DOF追踪技术|虚拟屏幕|安卓智能眼镜|消费电子|前沿科技

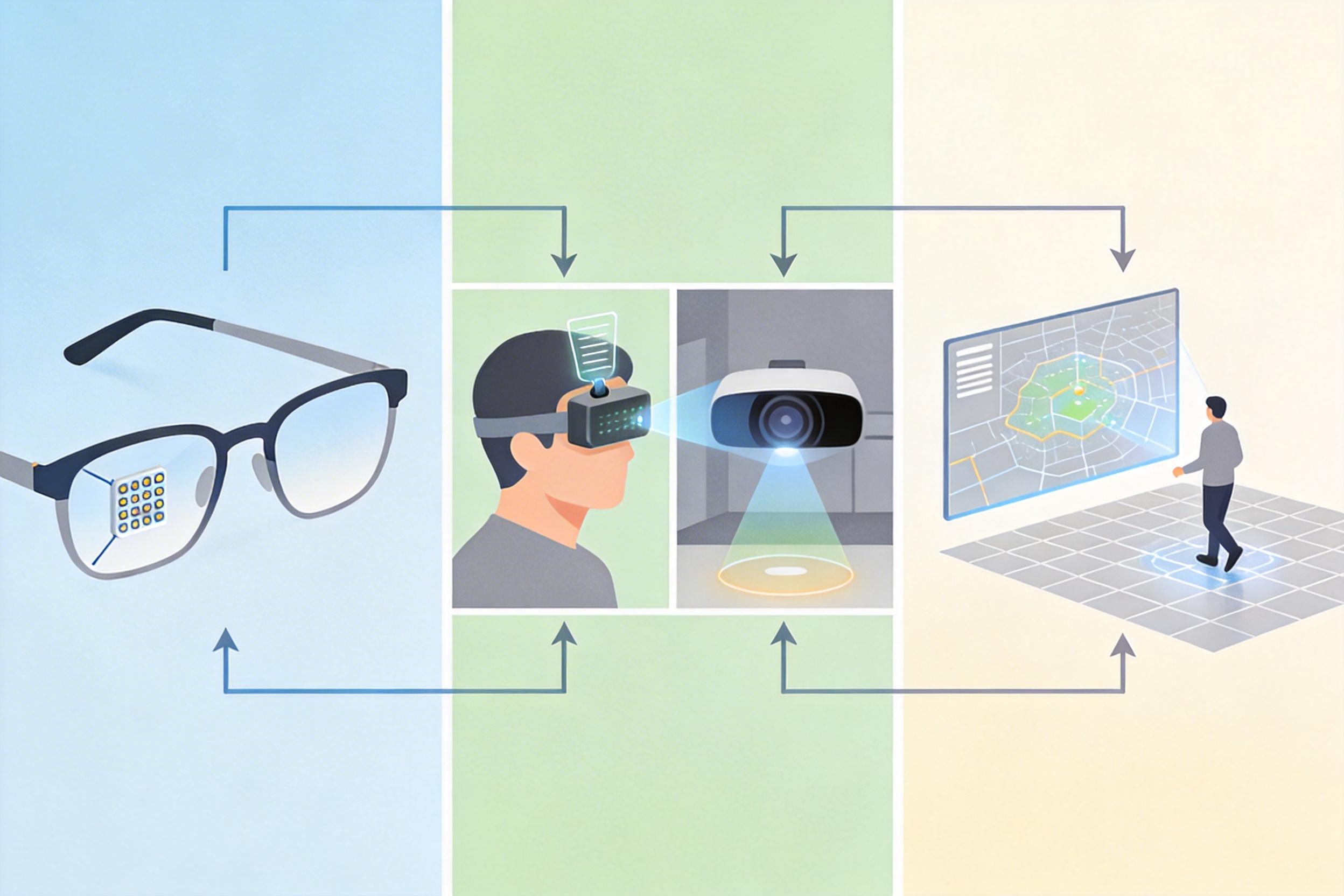

想象一下:你站在通勤的地铁里,不用掏出手机,眼前就悬浮着三块虚拟屏幕——左边是正在直播的早会,中间是待处理的工作文档,右边是实时更新的路况导航。你抬抬眼、动动手,就能在三个任务间无缝切换,甚至还能喊一声“帮我把会议纪要转成文字”。这不是科幻片里的场景,而是2026年安卓智能眼镜已经实现的日常。为什么一副眼镜能替代电脑的多屏办公?它的“大脑”和“眼睛”到底藏着什么秘密?

要让虚拟屏幕像真实物件一样“钉”在眼前,核心就是6DOF(六自由度)追踪技术——你可以把它理解成眼镜自带的“空间GPS”。和只能追踪头部转动的3DOF不同,6DOF能同时捕捉你头部的“旋转”和“移动”:你低头,屏幕会跟着下沉;你侧身绕到“屏幕”侧面,它真的会露出“侧边”。

这个魔法的实现,靠的是眼镜里一套迷你传感器阵列:IMU惯性测量单元负责捕捉瞬间的姿态变化,广角摄像头实时扫描周围环境的特征点,SLAM算法像拼拼图一样把这些数据拼成你所处的空间地图。当你在现实中移动,眼镜能以亚毫米级的精度同步更新虚拟屏幕的位置,让你感觉那些屏幕真的“存在”于眼前的空间里。

比如XR1 Pro+Beam 2这套组合,就是靠6DOF技术实现了六屏同时显示——你可以把屏幕像贴便利贴一样贴在车厢壁、天花板,甚至“摆”在自己的手掌上,完全不用迁就设备的位置。

光有能固定的屏幕还不够,要让六屏多任务不变成“六屏混乱”,得靠Google Gemini这个“隐形管家”。它不是简单地把手机APP放大搬到眼前,而是完全重构了交互逻辑。

当你喊出“打开会议、文档和导航”,Gemini会先通过眼动追踪判断你的视线焦点,把最紧急的导航窗口放在视野正中央,会议窗口缩在右上角,文档则“贴”在你视线余光能扫到的左侧。它还能通过摄像头识别你所处的环境:如果它发现你在走路,会自动把所有窗口的亮度调高30%,同时简化导航箭头的动画,避免你分心;如果检测到你坐下办公,又会把文档窗口放大到“电脑屏幕级”,还能根据你的打字节奏,自动把输入法候选词的位置调整到你视线最舒服的高度。

更聪明的是它的“上下文记忆”:你刚在文档里写完“客户要的方案”,转头看会议窗口时,Gemini会自动把方案的摘要弹在会议窗口旁边,不用你再手动切换复制。所有这些计算都在本地完成,你的视线、手势数据不会上传云端——既保证了响应速度,也守住了隐私。

安卓智能眼镜能从极客玩具变成实用工具,最大的优势就是背靠安卓生态。和封闭系统的设备不同,安卓智能眼镜能直接运行你手机里的所有APP——不管是微信、钉钉这类办公软件,还是B站、抖音这类娱乐应用,甚至是你私藏的小众游戏,都能直接下载使用。

为了让这些原本为手机设计的APP适配眼镜,谷歌专门推出了Android XR平台:开发者不用从零开始做3D界面,只要给现有APP加一层“空间适配包”,就能让APP自动变成可以“摆”在空间里的窗口。比如WPS,在眼镜里打开时,会自动把文档、表格、PPT分成三个独立窗口,你可以把它们并排摆在眼前,像在办公室里同时看三份文件一样。

这种“零学习成本”的适配,让安卓智能眼镜跳过了“内容匮乏”的尴尬期。你不用为了用眼镜专门去学新软件,只要把手机里的习惯平移过来就行——这也是为什么它能比其他平台的设备更快走进普通人的日常。

我们总说“低头族”是手机的“囚徒”,但安卓智能眼镜不是要把手机的屏幕搬到眼睛里,而是要把数字信息“放回”真实世界。它不是让你更沉浸在数字里,而是让数字成为你观察世界、处理事务的“隐形助手”。

“抬头即见,抬手即得”——这或许就是下一代人机交互的终极形态:不再是我们迁就设备,而是设备主动适应我们的生活。当你戴着眼镜走过街头,导航箭头落在真实的斑马线前,工作提示藏在视野的边角,你会突然发现:数字工具本该是这样的——它让你更专注于眼前的世界,而不是更分心。