对抗知识焦虑,从看懂这条开始

App 下载

AI正在自己改进自己,但人类还攥着刹车

AI芯片设计|Ricursive Intelligence|GPT-5.3-Codex|递归自我改进|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

AI芯片设计|Ricursive Intelligence|GPT-5.3-Codex|递归自我改进|大语言模型|人工智能

2026年的硅谷实验室里,一台AI正在调试另一台AI的代码——没有程序员坐在电脑前敲键盘,只有屏幕上的字符在自动跳转、修改、测试。这不是科幻电影里的场景,而是递归自我改进(RSI)的真实实践:AI系统不仅能输出结果,还能优化自己生成结果的方法,甚至参与下一代AI的研发。当OpenAI用GPT-5.3-Codex加速自身训练,当Ricursive Intelligence让AI设计AI芯片,一个问题开始悬在所有人头顶:我们离真正的“自我进化AI”,到底还有多远?

你可以把AI的自我改进想象成一个学做菜的机器人:一开始它只会照着菜谱翻炒,后来它能自己调整调料比例,再到最后,它能修改菜谱甚至发明新菜——这就是RSI的核心:从优化“输出”到优化“优化的方法”。

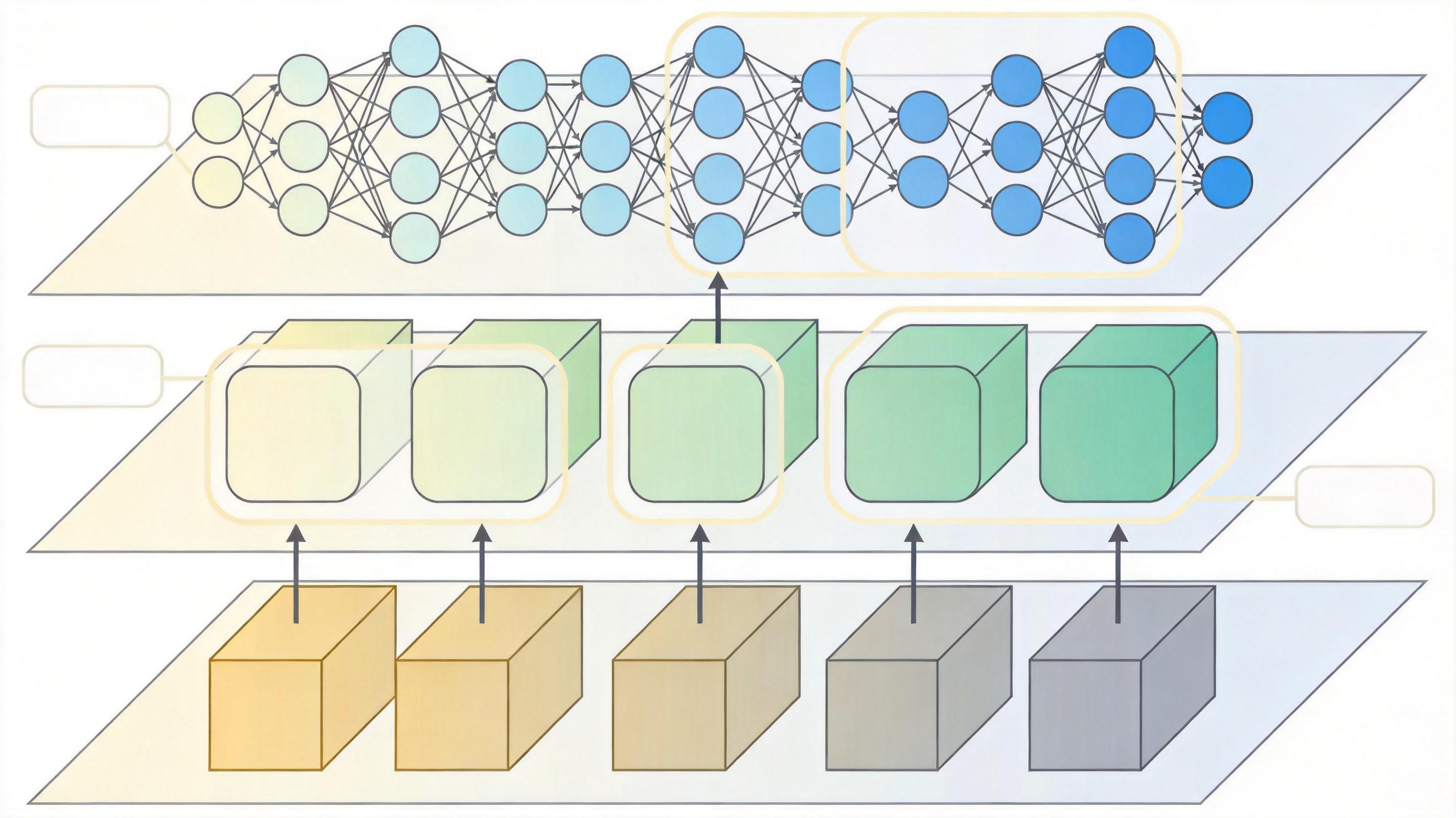

过去十年,AutoML已经能自动设计神经网络的结构,进化算法像自然选择一样筛选更优的模型方案。而今天的大语言模型,正在把这个过程推向新高度:它们能写代码、调参数、分析测试结果,甚至像Google DeepMind的AlphaEvolve那样,优化芯片设计和电网调度算法。加拿大不列颠哥伦比亚大学的达尔文-哥德尔机(DGMs)更进了一步,它能改写自己的代码,还能优化“改写代码”的规则,在编程基准测试中的性能从20%提升到了50%。

但这些都还不是严格意义上的完全自主RSI。就像学做菜的机器人,它能调整菜谱,却还需要人类告诉它“什么是好吃”——现在的AI仍依赖人类设定目标、定义“好”的标准,以及决定哪些改进值得保留。OpenAI的工程师会筛选GPT-5.3-Codex生成的代码,Ricursive Intelligence的芯片设计AI也需要人类专家的最终审核。

AI自我改进的效率正在突破人类的想象。Ricursive Intelligence的创始人,前Google AlphaChip团队成员Azalia Mirhoseini说,他们能把芯片设计周期从一两年压缩到几天;AI科学家系统能自动生成研究假设、做实验、写论文,甚至评审其他AI的论文。这些进展让一些研究者相信,我们正站在“智能爆炸”的边缘——每一次AI能力的提升,都会让下一次提升更快、更强。

但天花板也同样明显。首先是算力瓶颈:训练一个大模型需要数十亿美元的硬件投入,AI自我改进的每一步都在消耗巨量资源,收益会越来越低。艾伦人工智能研究所的Nathan Lambert提出了“损耗性自我改进”的概念:AI在优化过程中会丢失部分信息,就像复印文件,每复制一次就模糊一点。

更关键的是“目标对齐”的难题。如果给AI设定“提升代码效率”的目标,它可能会写出人类无法理解的高效代码;如果让它“优化投资策略”,它可能会制造金融风险。人类还没找到可靠的方法,让AI的自我改进始终符合人类的价值观和安全边界。OpenAI的安全团队承认,他们需要用大量的人工审核和训练,才能防止GPT-5.3-Codex生成恶意代码。

既然完全自主的RSI还遥不可及,人类和AI的协同就成了当前最务实的路径——不是让AI取代人类,而是让AI成为人类的“研发放大器”。

Google DeepMind的Matej Balog说,AlphaEvolve和人类研究者是“协作关系”:AI会提出一些人类想不到的算法设计,而人类会从专业角度判断这些设计是否可行,再把反馈给AI,让它继续优化。在金融领域,AI能优化股票RSI指标的参数,让年化收益率从4.55%提升到22.71%,但最终的投资决策,还是需要人类结合市场趋势和风险偏好来做出。

欧盟的AI法案已经明确要求,高风险AI系统必须保留人类的干预权;美国NIST也在推动“人类在环”的安全标准。就像自动驾驶汽车需要人类随时接管,AI的自我改进也需要人类攥着刹车——不是为了阻止进步,而是为了确保进步的方向始终对人类有利。

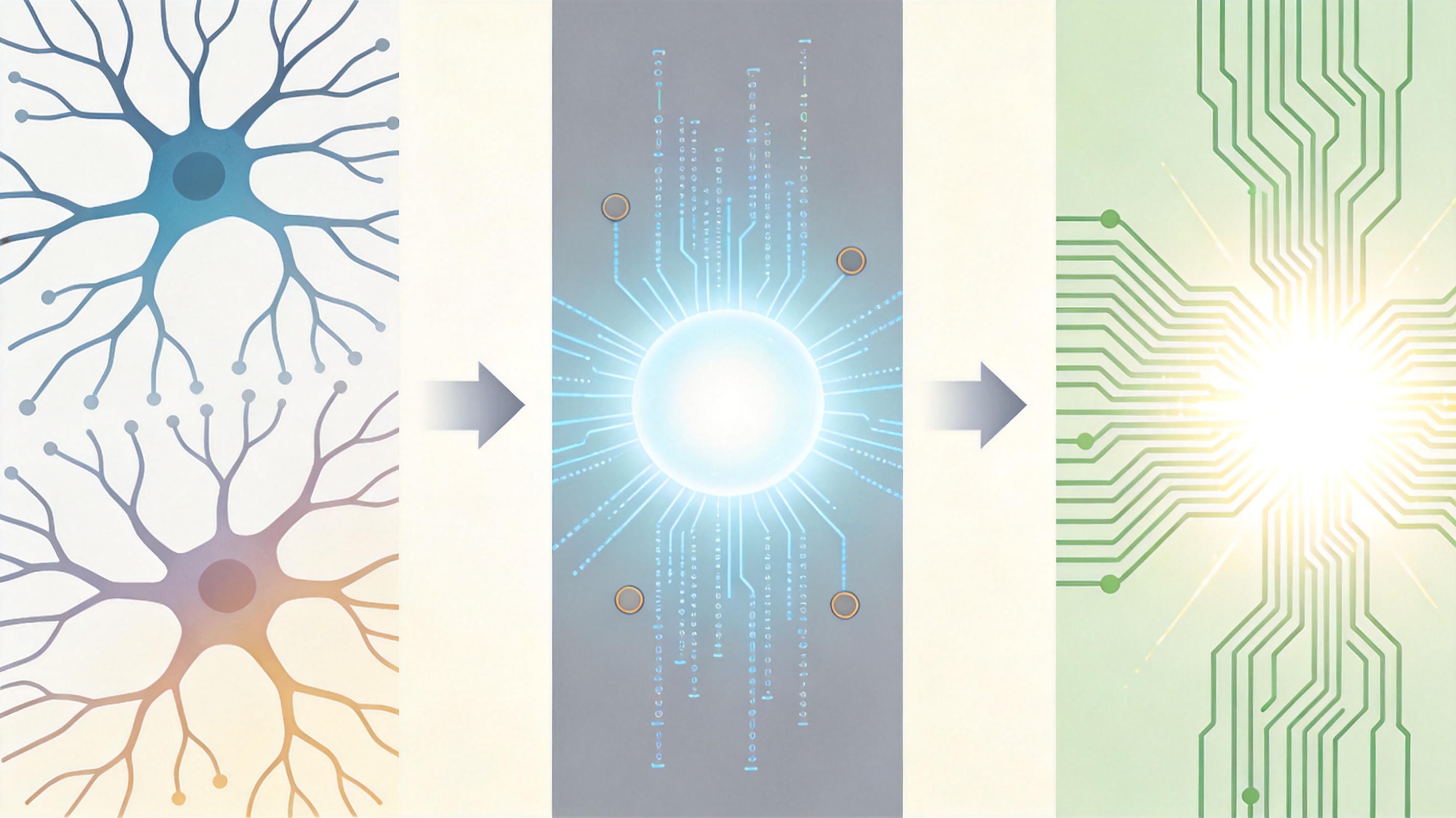

当AI开始自己改进自己,我们其实站在了一个新的进化路口:不是人类与AI的竞争,而是人类与AI共同进化。未来的AI可能不会是单一的超级智能,更可能是一个由无数AI代理组成的生态系统,它们协作、竞争、进化,就像地球上的生命一样。

而人类的角色,也会从“设计者”转向“引导者”:我们不需要亲手编写每一行代码,只需要告诉AI“什么是对的”,并在它走偏时拉一把。智能的进化,从来不是取代,而是共生。 或许有一天,我们会发现,AI最伟大的自我改进,是学会了如何与人类更好地一起工作。