对抗知识焦虑,从看懂这条开始

App 下载

大脑和AI的泛化能力,藏在神经活动的几何形状里

数学公式|泛化能力|几何形状|神经群体活动|SueYeon Chung团队|脑科学|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

数学公式|泛化能力|几何形状|神经群体活动|SueYeon Chung团队|脑科学|大语言模型|心理认知|人工智能

你在下班路上突然遇到临时封路,不用想就能绕进旁边的小巷;刚学会用咖啡机做美式,看一眼就能上手做拿铁——这种把旧经验用到新场景的「泛化能力」,人类大脑生来就会,但AI却总卡在这:换个角度的猫就认不出,改个句式的指令就执行错。

哈佛大学的物理学家SueYeon Chung团队最近捅破了这层窗户纸:不管是生物大脑还是人工神经网络,泛化能力的高低,居然都能通过神经群体活动的几何形状来精准预测。他们甚至拿出了一个统一的数学公式——这意味着,我们终于不用再把大脑和AI当「黑盒」,而是能像拆解钟表齿轮一样,看懂智能的底层逻辑。

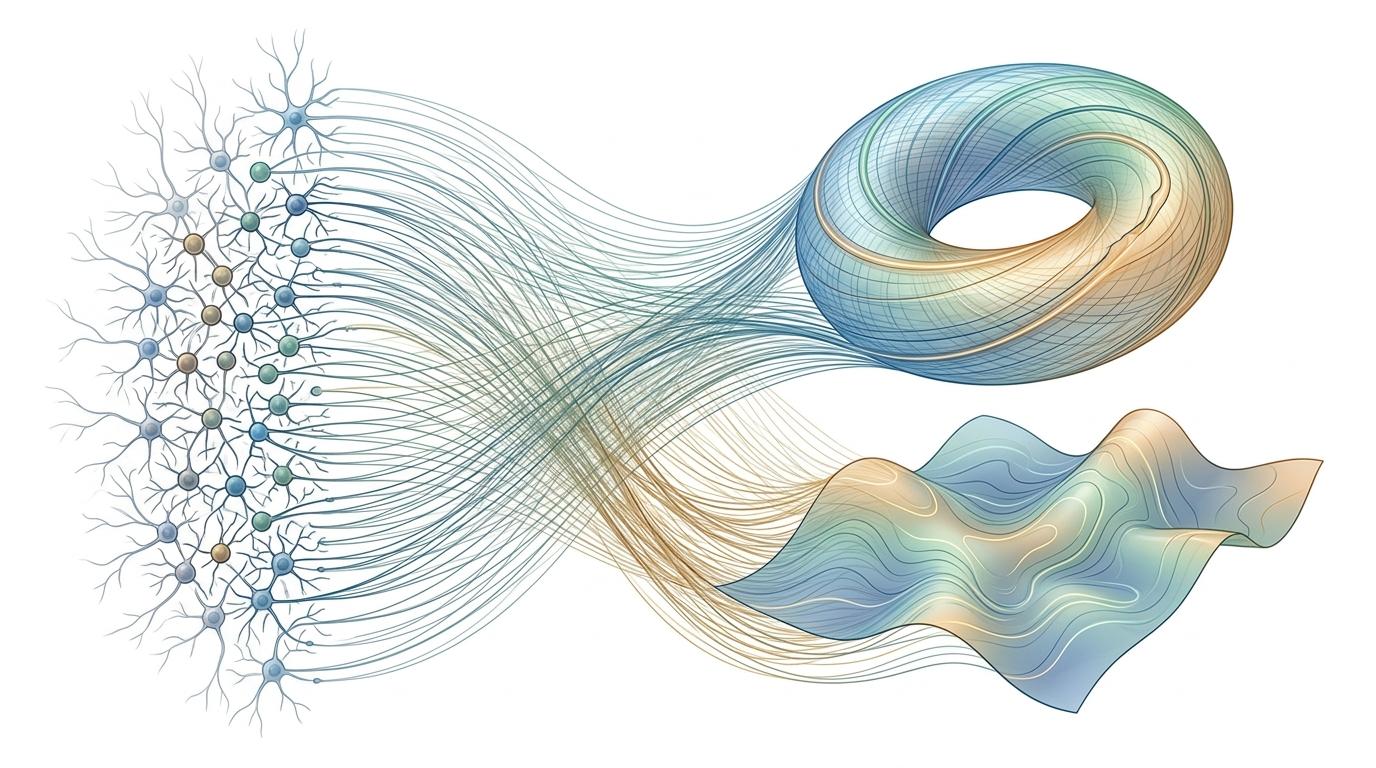

先搞懂一个核心概念:神经群体活动的几何结构——你可以把每个神经元的电信号想象成一根丝线,成千上万根丝线交织起来,会在高维空间里拧出特定的形状,比如像甜甜圈一样的「环面」,或者像展开的地图一样的低维流形。过去科学家只把这些形状当神经活动的「快照」,但Chung团队想搞清楚的是:这些形状,会不会就是智能的「源代码」?

他们从统计物理和几何学里找工具,最终推导出一个包含四个关键变量的公式,每个变量对应几何形状的一个特征:

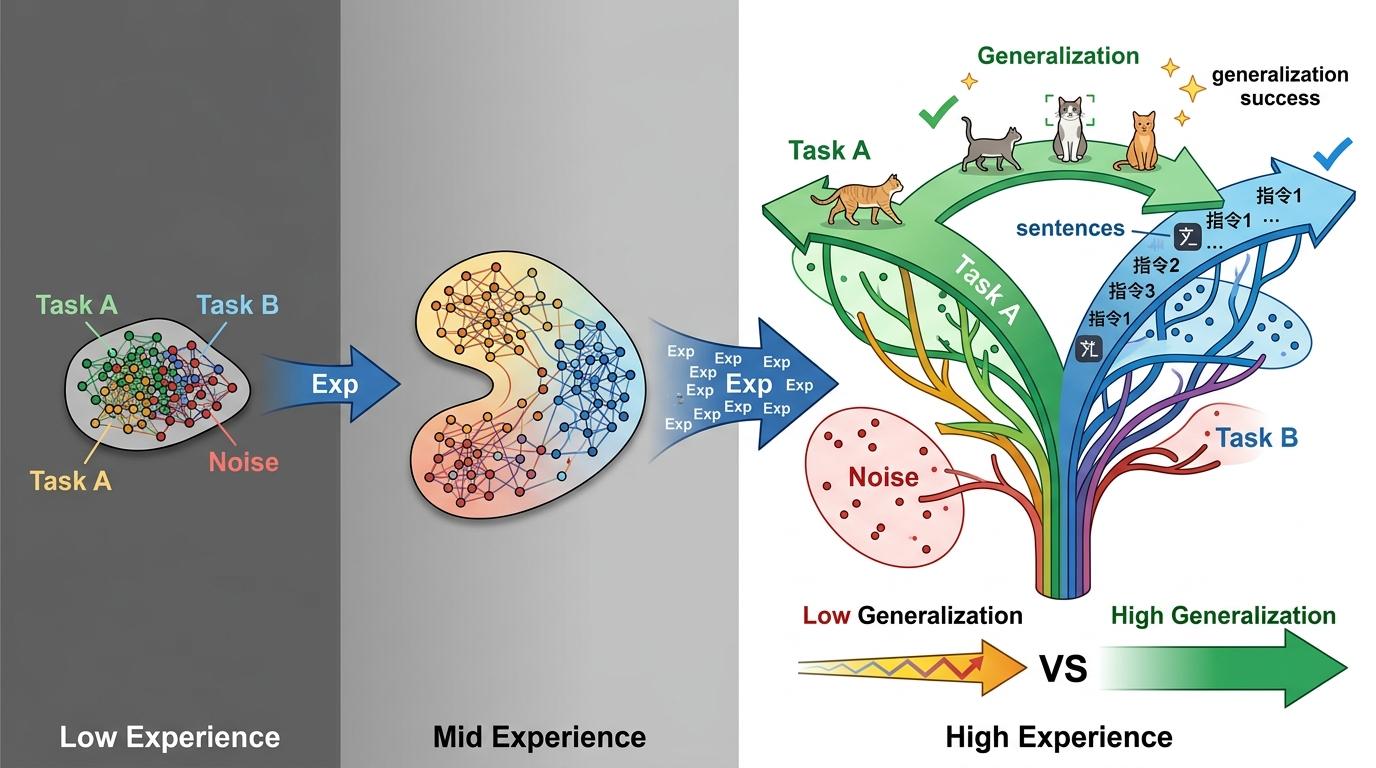

这个公式不是凭空编的。Chung团队用它测了老鼠的海马体数据、猴子的视觉皮层数据,还有不同结构的人工神经网络,结果四个变量的组合,居然能精准预测出这些系统在新任务里的表现——相关性越高、维度越合适、信号和噪声分得越开,泛化能力就越强。

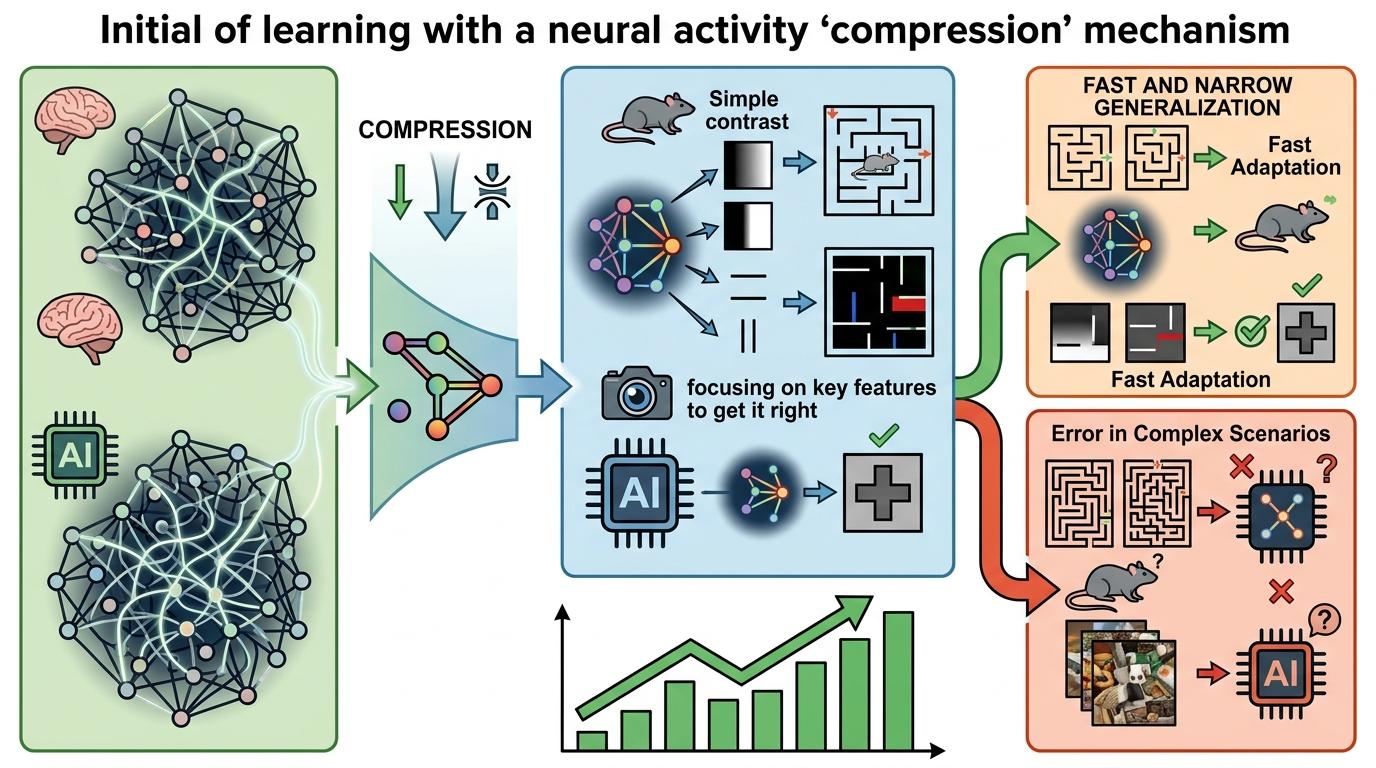

更有意思的是,不管是生物大脑还是训练中的AI,它们的神经几何形状都会经历一个「压缩-展开」的动态过程——这像是智能的「成长规律」。

学习刚开始时,不管是老鼠学走迷宫,还是AI学认图片,神经活动的形状都会先「压缩」成低维结构:比如只聚焦「明暗」「边缘」这种最核心的特征,先把事情做对。这时候的泛化能力是「快而窄」的——能快速适应类似场景,但稍微复杂一点就会出错。

随着经验积累,这个形状会慢慢「展开」:维度变高,不同的任务信息开始在空间里「各占一块」,信号和噪声也彻底分开。这时候的泛化能力就变成了「宽而稳」——猴子能认出不同角度的同一只猫,AI能处理从没见过的指令句式。

这个过程里藏着一个关键的平衡:低维压缩帮我们快速入门,高维展开帮我们应对复杂。Chung团队发现,大脑的厉害之处,在于能根据任务需求随时切换这个平衡——比如你第一次去陌生城市,大脑会先压缩到「找地标」「看路牌」的低维模式,等熟悉了,再展开到「规划最优路线」「发现小众店铺」的高维模式。而现在的AI,大多还停留在「要么压缩过头认不出新东西,要么展开过拟合旧数据」的尴尬里。

加州大学圣巴巴拉分校的Nina Miolane教授评价这项研究时说:「终于有人敢给智能下一个数学定义了」——过去我们研究智能,要么只看大脑的电信号,要么只看AI的输出结果,就像隔着雾看山,只能看到轮廓。而这个几何框架,相当于给了我们一把能打开黑盒的钥匙。

但它也不是万能的。比如它目前只适用于基于连续信号的神经活动,对于大脑里的脉冲信号,或者人类特有的「创造性泛化」——比如用已知的音符写出从没听过的旋律,还没法完全解释。而且,这个公式里的四个变量,还需要更精准的实验数据来校准:比如不同脑区的神经维度,到底多少才是「合适」的?

更重要的是,这项研究的意义不止于解释智能,更在于改造智能。比如未来我们训练AI时,不用再盲目堆数据调参数,而是可以直接盯着它的神经几何形状:如果形状太扁,就加一点维度;如果信号和噪声混在一起,就调整训练策略把它们分开。甚至对于神经疾病的治疗,比如阿尔茨海默病患者的神经活动形状会变得混乱,我们或许能通过调整这些几何特征,来改善他们的认知能力。

当我们把神经活动拆解成几何形状,把泛化能力转化成数学公式,其实是在做一件最朴素的事:试图看懂「智能」到底是什么。它不是大脑里某个神秘的「灵魂」,也不是AI里一堆看不懂的参数,而是一种可以被量化、被拆解、被复刻的几何结构。

智能的本质,是形状的演化。

未来的某一天,当我们给AI设计神经活动的「甜甜圈」,当我们给大脑里混乱的神经形状「做整形」,或许我们会突然发现:原来人类和机器的智能,从来都不是两条平行线,而是在高维空间里,朝着同一个方向生长的几何形状。