对抗知识焦虑,从看懂这条开始

App 下载

AI的“货物崇拜”危机:费曼的幽灵拷问技术黑箱

AI发布会|科学精神|技术黑箱|理查德·费曼|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

AI发布会|科学精神|技术黑箱|理查德·费曼|大语言模型|人工智能

在一间灯火通明的发布会现场,一位科技领袖正激情澎湃地展示着最新的人工智能系统。屏幕上,绚丽的动画滑过:发光的神经网络、流动的数据、自信上扬的箭头。台上的演示完美无瑕,系统“理解”语言,“推理”世界,“发现”新知。台下掌声雷动,投资者与媒体的目光中充满了对未来的憧憬。

如果物理学家理查德·费曼(Richard Feynman)此刻坐在最后一排,他或许不会鼓掌。这位生性不羁、热爱敲邦戈鼓的诺贝尔奖得主,大概率会等到喧嚣散去,然后举手,用一个看似简单却直击要害的问题打破这片祥和:“你怎么知道?”

这个问题,正是半个世纪前费曼为科学精神立下的基石,如今却像一道幽灵,盘旋在人工智能这座看似坚不可摧的殿堂之上,拷问着我们这个时代的“黑箱”技术与表象崇拜。

“第一原则是,你绝不能欺骗自己——而你,正是最容易被欺骗的人。”1974年,费曼在加州理工学院的毕业典礼上如此告诫年轻的学子。这并非空洞的哲学说教,而是他一生践行的工作指南。

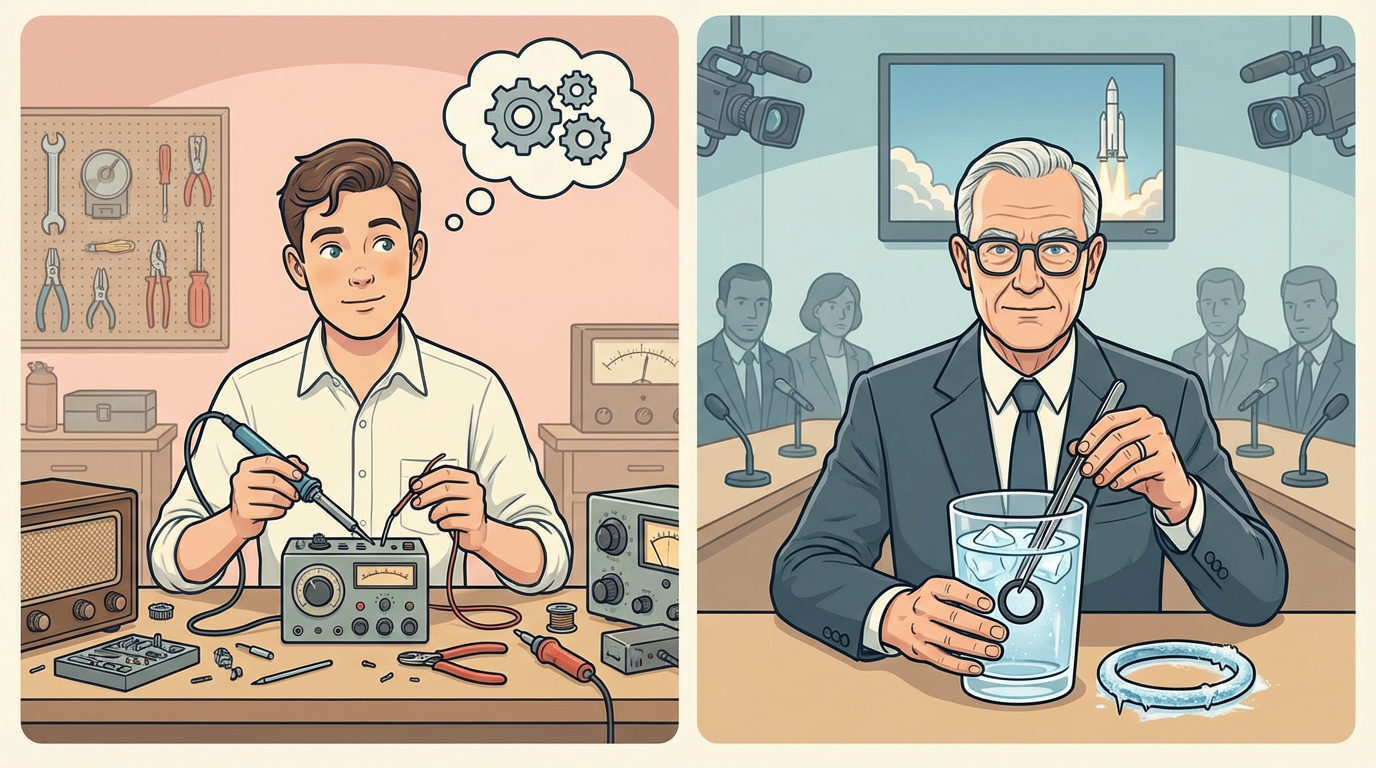

费曼的故事充满了对权威的蔑视和对实验的执着。少年时,他凭着直觉和动手能力修理收音机,无需电路图。而在他生命晚期,最著名的一次公开亮相,是作为调查委员会成员,揭示1986年“挑战者号”航天飞机灾难的真相。当时,美国国家航空航天局(NASA)的官僚们给出了层层叠叠的复杂解释。费曼却绕开他们,直接与工程师对话,并在电视直播中,将一个O型环浸入一杯冰水中。短短几秒钟,橡胶环失去了弹性——一个简单的实验,将灾难的根本原因暴露在全世界面前。

在他看来,修理收音机和解释航天飞机灾难是同一个问题:**权威掩盖了现实,而一个简单的实验足以揭示真相。**这种思维方式,在机器学习和神经网络主导的今天,显得尤为重要。当一个AI模型给出了令人惊艳的答案时,我们是选择相信,还是像费曼一样,拿起那杯“冰水”去测试它的极限?

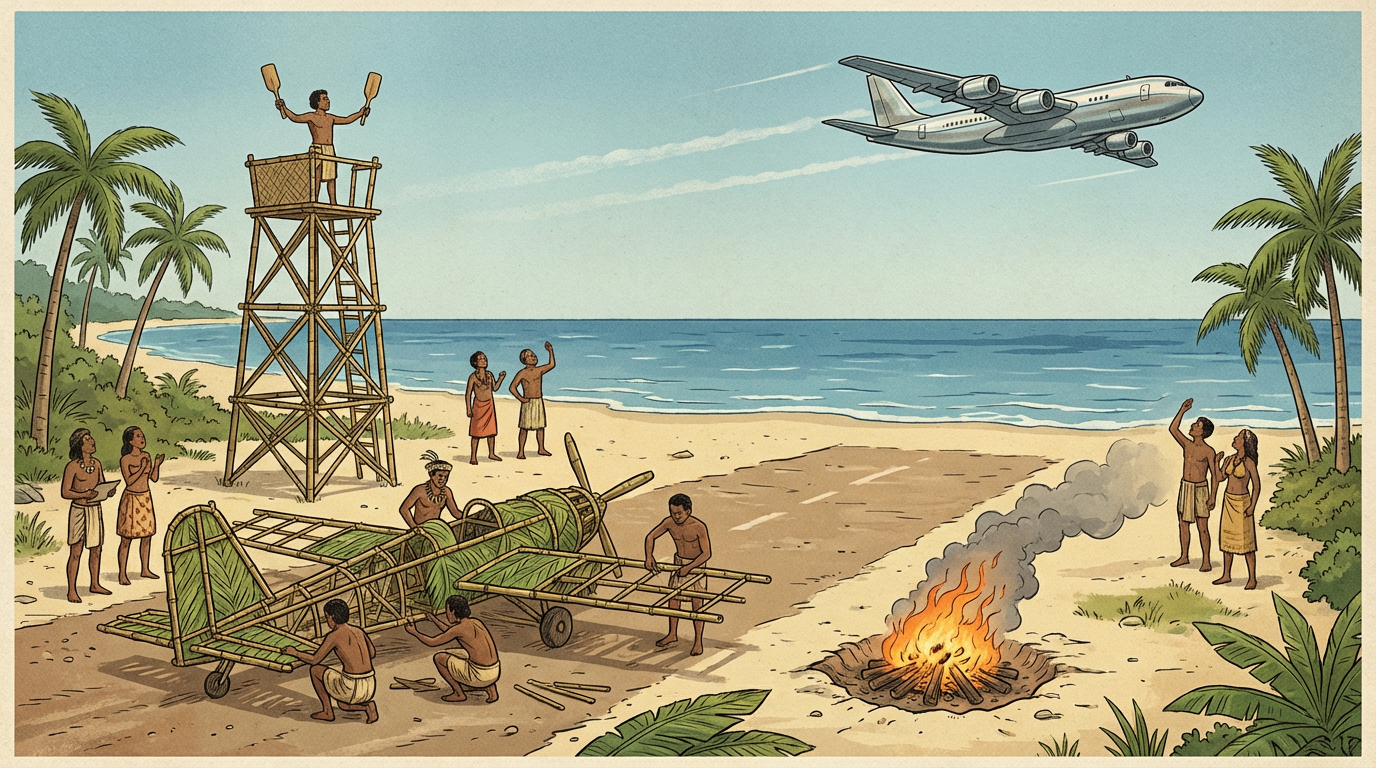

费曼在那次著名的演讲中,提出了一个深刻的概念:“货物崇拜式科学”(Cargo Cult Science)。二战后,南太平洋一些岛屿的居民模仿美军建造木制跑道、竹制指挥塔,甚至点燃篝火作为信号,希望能再次吸引运送物资的“神机”降落。他们复制了仪式的全部外在形式,却唯独缺少了科学的核心——理解其内在原理。

“他们遵循了所有表面上的规则,”费曼说,“但飞机没有降落。”

今天的AI领域,正笼罩在类似的阴影之下。我们看到的是令人眼花缭乱的“仪式”:

这种只重表象而轻实质的现象,正是“货物崇拜式AI”。它能产出看似正确的结果,却无法保证这些结果是可靠、公平或真正源于理解。当我们将这种技术应用于医疗、金融和司法等高风险领域时,“飞机”不仅可能无法降落,甚至可能坠毁。

过度依赖和信任不透明的AI系统,已经导致了一系列代价高昂的失败。这些案例并非孤例,而是系统性风险的集中爆发:

医疗领域的误判:IBM的Watson癌症诊断项目曾被寄予厚望,宣称能为医生提供精准的治疗方案。然而,现实却是,它多次给出错误甚至危险的建议,比如向一名有大出血风险的患者推荐可能加剧出血的药物。最终,这个耗资数十亿美元的项目黯然收场。

金融市场的溃败:房地产公司Zillow曾试图利用AI算法预测房价,并直接下场买卖房屋。然而,其模型未能捕捉到市场的微妙变化和复杂的人类行为,导致公司在2021年巨亏数亿美元,并裁员2000人。

社会领域的偏见:亚马逊曾开发AI招聘工具来筛选简历,却发现系统严重歧视女性,因为它学习了过去十年以男性为主导的招聘数据。AI没有创造偏见,但它像一面放大镜,忠实地复制并固化了人类社会既有的不公。

科学研究的乌龙:2023年,谷歌DeepMind宣布其AI工具GNoME发现了220万种新晶体结构,被誉为材料科学的巨大突破。但后续分析指出,其中大量结构只是对已知结构的微小改动甚至是重复,超过8.3万条记录被悄然删除,所谓的“巨大突破”蒙上了阴影。

这些失败的根源,并非技术不够强大,而是我们忘记了费曼的警告:仅仅拥有看似强大的工具,并不等同于拥有科学的严谨与诚实。

面对AI带来的挑战,我们并非束手无策。解药,就蕴藏在费曼所倡导的科学核心价值之中。

首先是质疑。科学的进步源于怀疑,而非盲从。在AI时代,这意味着我们不能仅仅满足于AI给出的答案,而要不断追问“为什么”。这催生了“可解释性AI”(XAI)的发展,其目标就是打开“黑箱”,让模型的决策过程变得透明、可追溯。一个值得信赖的系统,不是一个从不犯错的系统,而是一个我们知道它在何处会犯错、为何会犯错的系统。

其次是实验。费曼用一杯冰水就能戳破谎言,我们同样需要为AI设计严苛的“压力测试”。这意味着要主动寻找模型的弱点,用边缘案例、对抗性样本去攻击它,观察它的“失败模式”。一个只在理想条件下运行良好的模型,在混乱的现实世界中是脆弱的。企业和研究机构需要建立一种文化,鼓励报告失败,而不是隐藏它们。因为在科学中,一个经过验证的“此路不通”的结论,其价值不亚于一个成功的发现。

最后是诚实。这意味着对AI的能力有清醒的认知,不夸大、不炒作。开发者需要诚实地向公众说明模型的局限性、潜在的偏见以及数据来源。用户也需要对自己保持诚实,承认AI是辅助工具,而非可以全权托付的“神谕”。在高风险决策中,保留“人在回路”(Human-in-the-loop)的监督和最终决定权,不仅是技术上的保障,更是伦理上的必需。

1955年,费曼在一次演讲中引用了一句佛教谚语:“赠予每个人一把打开天堂之门的钥匙,而这把钥匙,也能打开地狱之门。” 他说,科学,就是这把钥匙。

今天,人工智能正成为这把钥匙新的、更强大的化身。它既能加速科学发现,优化社会资源,也能固化偏见,制造虚假信息,甚至在关键时刻导致灾难性的误判。它会转向哪扇门,不取决于技术本身,而取决于我们——它的创造者和使用者。

我们是否愿意放慢脚步,在惊叹于AI的强大性能之余,多问一句“你怎么知道?”我们是否能建立一种容忍不确定性、鼓励批判性思维的文化,而不是被风险投资的狂热和媒体的炒作所裹挟?

费曼或许无法想象今天的AI世界,但他留下的思想遗产——对真理的敬畏、对未知的谦逊、以及永不自欺的诚实——正是我们穿越这个充满机遇与迷雾时代的最佳指南。这不仅是科学家的美德,更应成为每个与AI共存的现代公民的必备素养。