对抗知识焦虑,从看懂这条开始

App 下载

大模型催熟微服务,治理比代码更关键

自动化代码生成|GPT-4|API密钥管理|OpenAPI规范|微服务治理|软件工程|大语言模型|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

自动化代码生成|GPT-4|API密钥管理|OpenAPI规范|微服务治理|软件工程|大语言模型|前沿科技|人工智能

2026年初,某科技团队的微服务数量在半年内翻了三倍——不是业务爆发,而是大语言模型(LLM)成了开发主力。过去需要3人一周完成的图像生成服务,现在一个工程师对着GPT-4描述需求,几小时就能生成带OpenAPI规范的完整代码,连单元测试都自动写好了。但没人料到,三个月后团队陷入了新麻烦:某个微服务的OpenAI API密钥过期,导致整个图片渲染链路瘫痪,排查了半天才找到那个被遗忘在角落的独立仓库。LLM把微服务的开发门槛拉到了历史最低,却也把治理的难题推到了台前。

你可以把微服务理解成一个个独立的“功能快递盒”——每个盒子只装一件事,外面贴着清晰的快递单(API规范),收件人不用管盒子里的东西怎么装,只要按地址寄件就能收到结果。而LLM就像个手脚麻利的打包工,擅长把零散的需求快速塞进标准化的盒子里。

这种契合来自两个核心逻辑:一是微服务的“小而专”刚好匹配LLM的代码生成能力边界——它能高效完成单一功能的代码,却搞不定单体应用里盘根错节的依赖;二是明确的API契约给了LLM“胡作非为”的空间——只要对外的接口不变,它可以在服务内部随意重构代码,哪怕把缓存逻辑全换了,调用方也毫无感知。

有数据显示,用LLM生成微服务代码,平均能节省30%-40%的开发时间。某电信团队迁移CRM系统时,靠GPT-4生成的OpenAPI规范和基础代码,把原本半年的迁移周期压缩到了两个月。但这种“快”也暗藏隐患:LLM生成的代码常缺少年限验证、SQL注入防护等细节,而独立仓库的宽松权限又让这些问题容易躲过代码审查。

当LLM把微服务的开发成本降到近乎为零,“服务爆炸”就成了必然结果。某互联网公司的后端团队,2025年还只有不到50个微服务,2026年中就突破了200个——其中近三分之一是工程师为了快速实现某个小功能,用LLM生成后直接上线的。

这些“野生”微服务带来的麻烦远超想象:它们可能用着独立的数据库却没做备份,可能硬编码了API密钥却没人记录,可能因为没人维护而悄悄停止更新。2026年第一季度,全球有17%的微服务故障来自“无人认领”的服务,其中60%是LLM快速生成后被遗忘的。

更隐蔽的是技术债务的积累。LLM生成的代码常带有“提示债务”——比如为了让模型理解需求而写的复杂提示词,或是为了兼容旧版本而留下的冗余逻辑。某研究显示,LLM相关项目中,平均每千行代码就有近18条技术债务,其中近70%来自不合理的提示设计和框架集成。

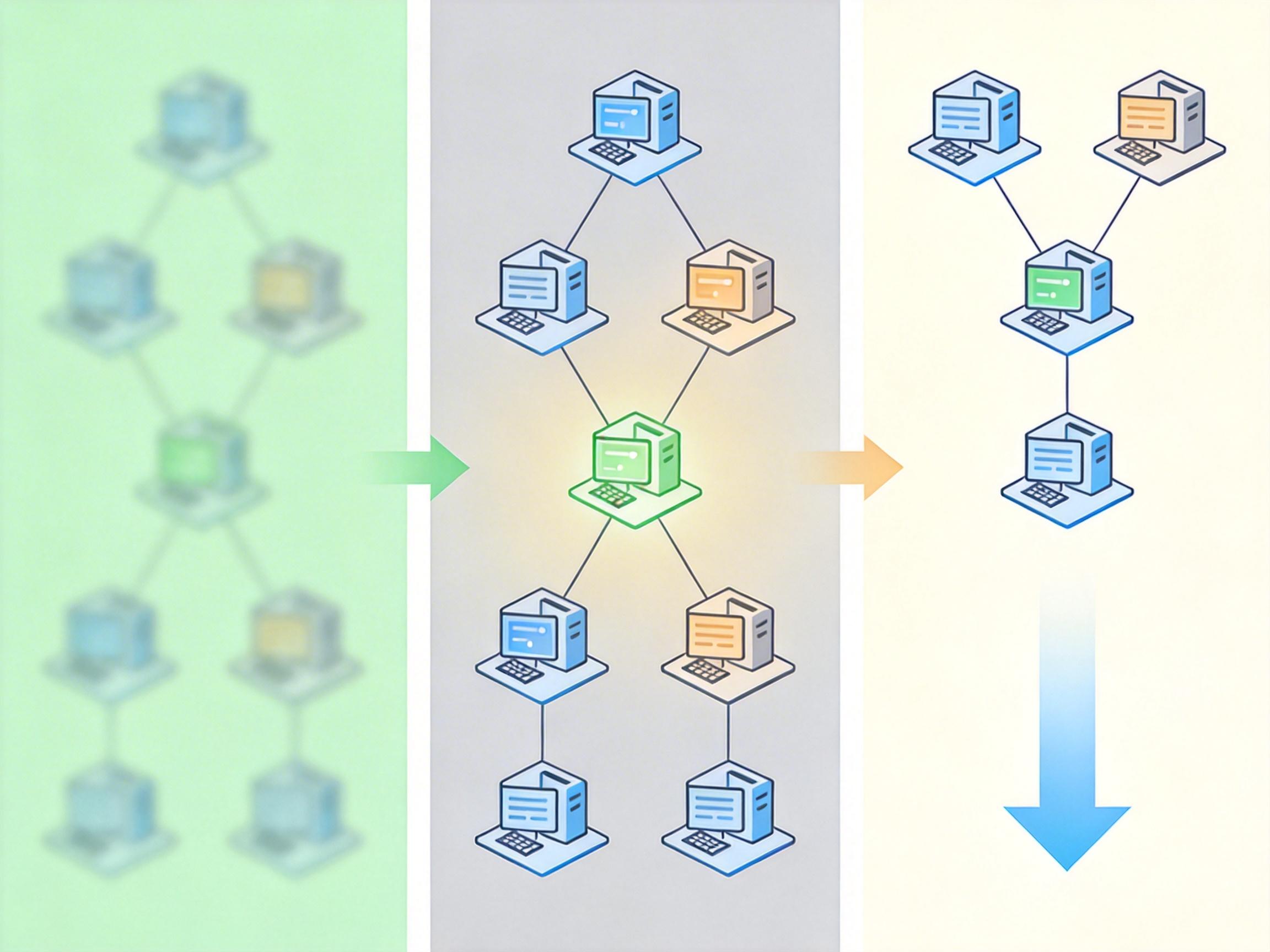

面对LLM催生的微服务乱象,企业开始重构管理逻辑——从“管代码”转向“管服务全生命周期”。

首先是建立服务所有权制度。某金融科技公司要求每个微服务必须绑定明确的负责人,服务的API密钥、数据库权限、部署记录都要在统一平台归档,一旦出现无人认领的服务,直接触发告警回收资源。这套制度实施后,他们的微服务故障发生率下降了42%。

其次是自动化治理工具的普及。现在已经有工具能通过LLM分析微服务的调用链,自动识别冗余服务、检测未授权的API调用,甚至能生成服务的废弃通知。某云厂商的微服务治理平台,靠LLM分析日志和代码,能把服务依赖图的生成时间从几天缩短到几小时。

更关键的是团队协作模式的转变。AI编码工具让开发者的生产力瓶颈从“写代码”转移到了“需求澄清”和“代码审查”。某团队引入AI代码审查机器人后,把人工审查的重点从“代码对错”转向“架构合理性”和“安全风险”,既提升了效率,也守住了治理的底线。

当LLM把微服务的开发变成“搭积木”,我们才发现,真正决定系统稳定性的,从来不是积木的数量,而是搭积木的规则。LLM让每个工程师都能快速创建服务,却也要求企业建立更精细化的治理体系——既要给创新松绑,也要给风险上栓。

“效率的边界,从来都是治理的起点。”未来的软件开发,比拼的不再是谁能更快写出代码,而是谁能在快速迭代的同时,守住架构的底线。毕竟,一堆零散的积木搭不出稳固的房子,只有用规则把它们串联起来,才能真正发挥微服务的价值。