对抗知识焦虑,从看懂这条开始

App 下载

英投百万建MindTech实验室,拆解「脑读写」的伦理与认知挑战

认知变革|伦理挑战|脑读写技术|格拉斯哥大学|MindTech实验室|脑科学|科学哲学|社会人文|心理认知

对抗知识焦虑,从看懂这条开始

App 下载

认知变革|伦理挑战|脑读写技术|格拉斯哥大学|MindTech实验室|脑科学|科学哲学|社会人文|心理认知

2026年3月,英国研究与创新署砸下100万英镑,支持格拉斯哥大学与牛津大学的跨学科团队成立MindTech研究实验室。这不是一个普通的技术研发项目——它把哲学家、神经科学家、量子物理学家塞进同一个团队,核心目标不是先造出新的脑机接口,而是先搞懂:当硅基芯片和人类神经深度绑定,我们的认知会变成什么,我们又该如何守住自己的「思想边界」。这是第一次,哲学被放在和神经技术同等的优先级,试图从源头给即将爆发的「脑读写时代」套上缰绳。

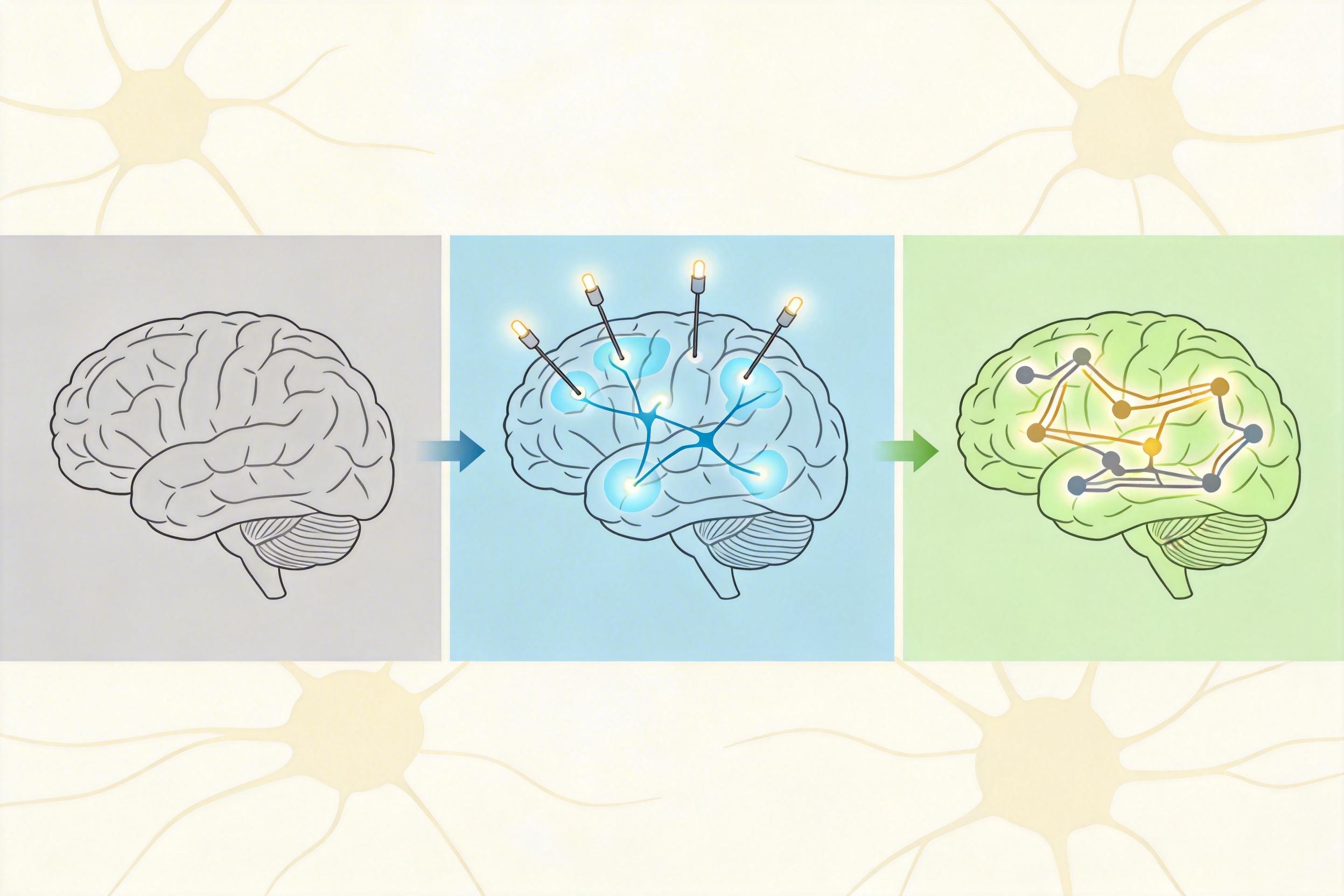

你可能已经听过「脑机接口能读心」的说法,但MindTech团队要先纠正这个误解:所谓「脑阅读」,本质是通过解码脑电信号的神经印迹,捕捉特定心理状态与神经活动的对应关系——它读不出完整的「想法」,只能识别比如「你在想写哪个字」「你对这个信息是否熟悉」这类碎片化的神经反应。比如P300脑电波,能通过潜意识信号推断你是否知道某个隐私信息,这已经足以让「思想隐私」不再是绝对的禁区。

而「脑写入」则是反向操作:通过电刺激或光遗传学手段直接调控脑区活动,比如给帕金森患者植入电极缓解震颤,或是通过神经刺激改善抑郁症状。但它的潜在边界远不止医疗——未来可能直接把一段信息「写」进你的记忆,或是调节你的注意力水平。

当前最成熟的脑阅读技术,已经能实现90字符/分钟的「思维打字」,准确率超过94%,接近普通人手机打字的速度;脑写入技术则在医疗领域站稳了脚跟,但距离「编辑记忆」这类科幻场景,还有5-10年的技术攻关期。但MindTech的研究者最关心的不是「能不能」,而是「该不该」——哪些技术该优先发展,哪些可能把我们拖入无法挽回的伦理陷阱。

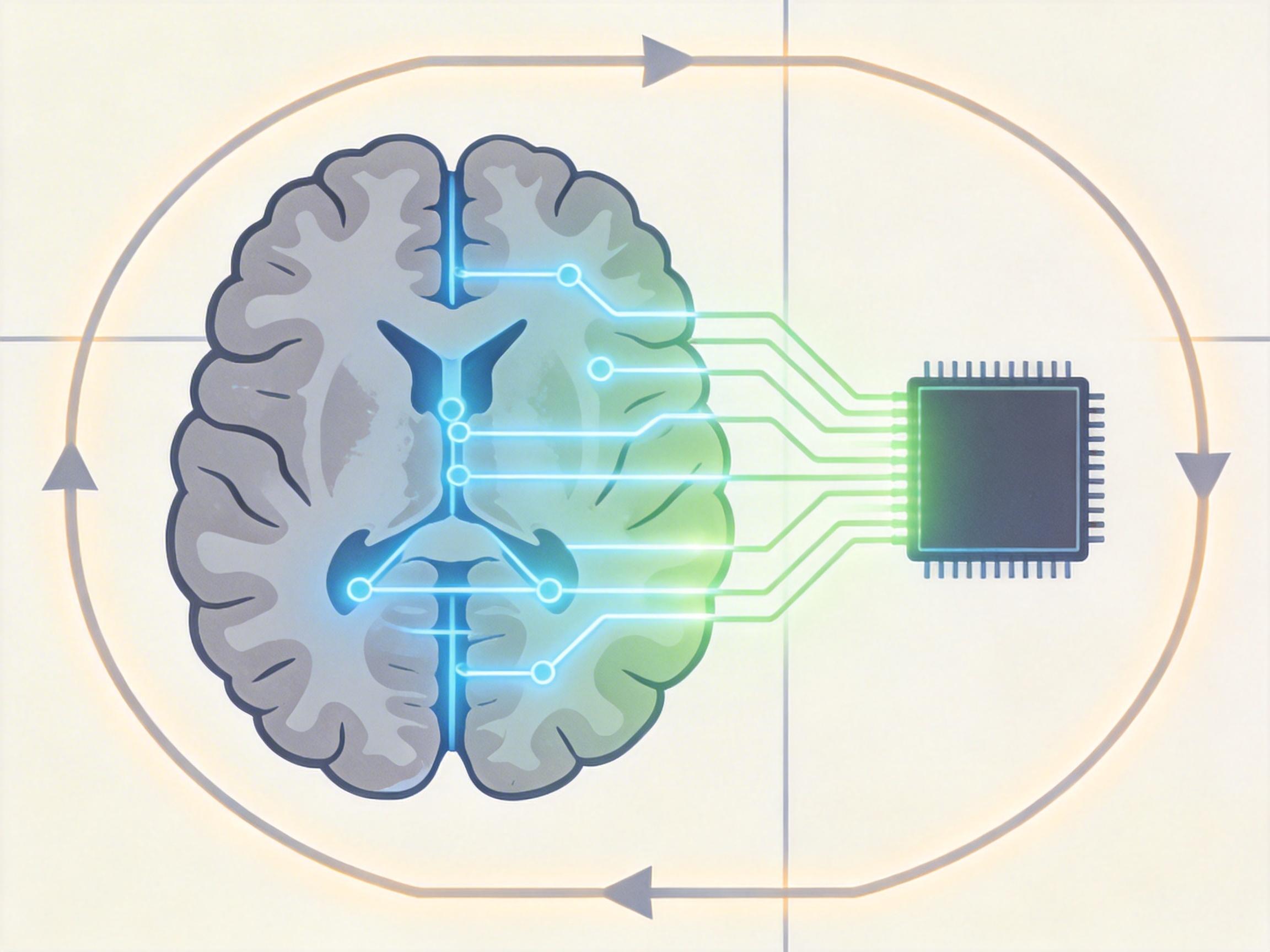

当你把硅基芯片和人类大脑绑在一起,最核心的问题不是「算力提升了多少」,而是「我们的认知到底是怎么被改变的」。这正是MindTech团队要啃的硬骨头——他们要搞懂,当硅基计算的逻辑和神经计算的逻辑交织,人类的记忆、决策、知识获取会发生什么本质变化。

举个例子:现在的脑机接口大多是「单向」的,要么读要么写,但未来的双向闭环系统,会让芯片和大脑实时互动——芯片读取你的脑信号,做出决策,再把结果「写」回大脑,形成一个硅基-神经混合的认知回路。这时候,你很难说清「某个想法到底是你自己的,还是芯片帮你生成的」。

从知识论的角度看,这直接挑战了我们对「知识」的定义:以前我们认为知识是「通过自身认知形成的信念」,但如果芯片直接给你植入了一段「记忆」,并且你完全相信它是真实的,那这段「植入的知识」算不算真正的知识?更现实的风险是,当神经技术能精准调节你的注意力和判断力,你会不会更容易被操纵和误导?MindTech的研究者正在设计实验,测试神经增强技术是否会让人更容易相信虚假信息——这不是科幻,是未来5-10年就要面对的现实。

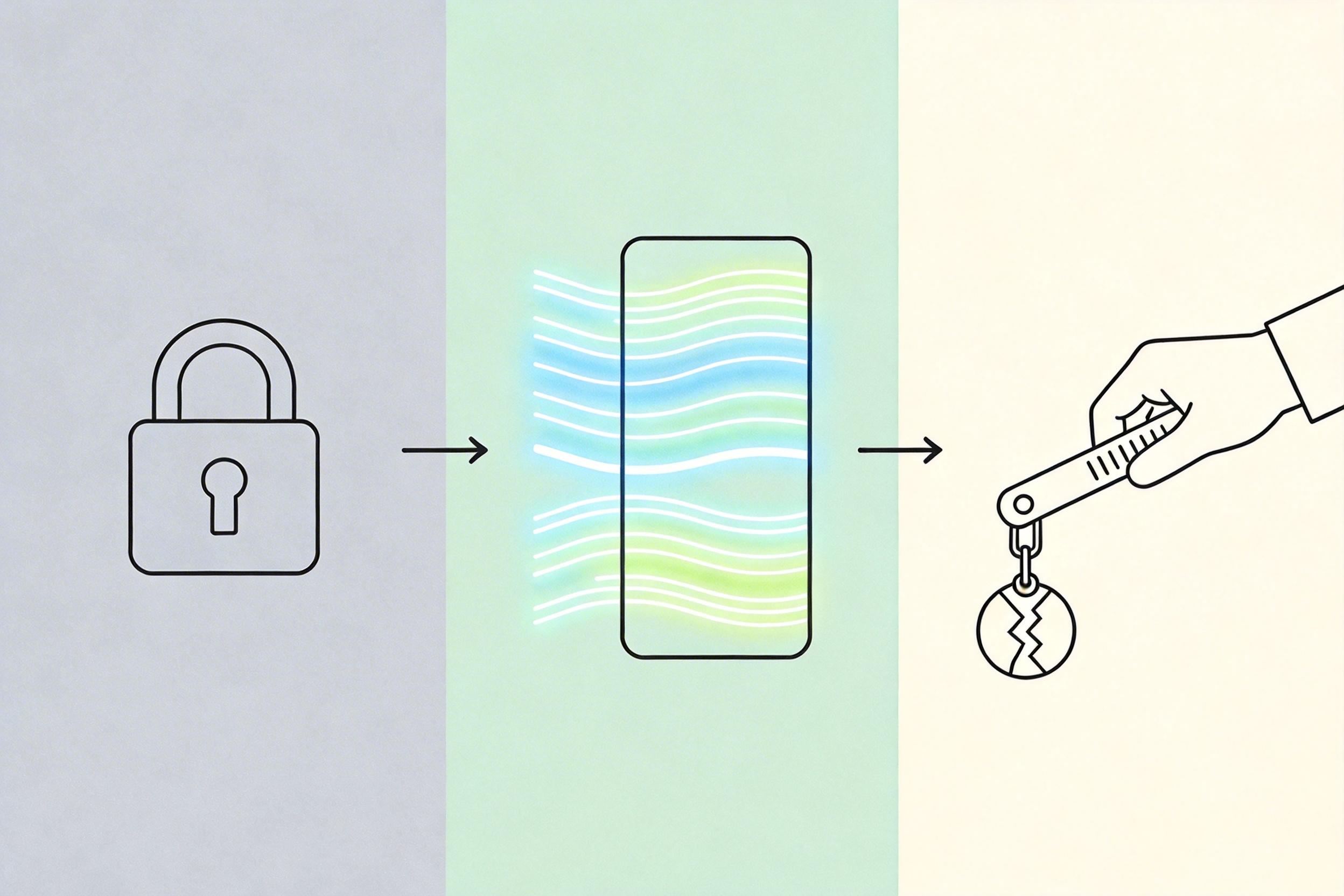

MindTech实验室的最大意义,是把伦理和知识论从「技术的附属品」变成「技术的起点」。以前的模式是:技术先做出来,伦理学家再跳出来说「这有问题」,但MindTech的模式是:哲学家和科学家一起设计实验,从一开始就把「认知自由」「心理隐私」「身份认同」这些问题写进研发手册。

比如他们正在研究的「动态知情同意机制」——传统的知情同意是签一次字就完事,但神经技术的风险是动态变化的,你今天同意植入的设备,未来可能被升级出你完全没预料到的功能。MindTech的方案是,建立一套实时更新的知情同意系统,让用户随时能了解设备的新功能和新风险,随时可以撤回授权。

但这种模式也有局限:跨学科沟通的成本极高,哲学家和神经科学家的语言体系几乎是两套;而且伦理规范永远赶不上技术迭代的速度——今天你刚制定了「脑阅读不能用于司法审讯」的规则,明天可能就有人开发出了更精准的记忆解码技术。MindTech的研究者也承认,他们能做的不是「解决所有问题」,而是建立一个「能跟上技术的伦理框架」,让我们在神经技术的狂奔中,不至于完全失控。

当我们谈论神经技术,我们其实在谈论人类的未来——是变成「硅基-神经混合的超级认知体」,还是被技术消解了自身的独特性?MindTech实验室的100万英镑,本质是在为这个未来买一张「保险单」——它试图用哲学的冷静,去平衡技术的狂热。

历史上每一次技术革命,都是先突破边界,再回头收拾烂摊子:蒸汽机带来了环境污染,互联网带来了隐私危机,而神经技术带来的,可能是对「人类本质」的挑战。这次,我们终于试着在突破边界之前,先想清楚「边界在哪里」。

技术向善,始于认知边界的守护。