11 天前

11 天前

想象一下,你刚在电脑里敲完一行代码,转身喝口水的功夫,屏幕上的字就凭空少了一半——而且每次丢的位置都不一样。这不是科幻片里的故障,而是量子计算机每天都在经历的噩梦。

量子比特,就是量子计算机的「存储单元」,它靠量子态存储信息,但这些态像风中的烛火,说灭就灭。更头疼的是,它熄灭的速度完全没规律:这次能撑0.5毫秒,下次可能突然就只剩0.1毫秒。过去科学家要测一次它的「熄火速度」,得等1秒——相当于等一个人烧完一壶水,才看清他刚才划火柴用了多久。直到挪威科技大学和尼尔斯·玻尔研究所的团队,把这个测量速度提了100倍。

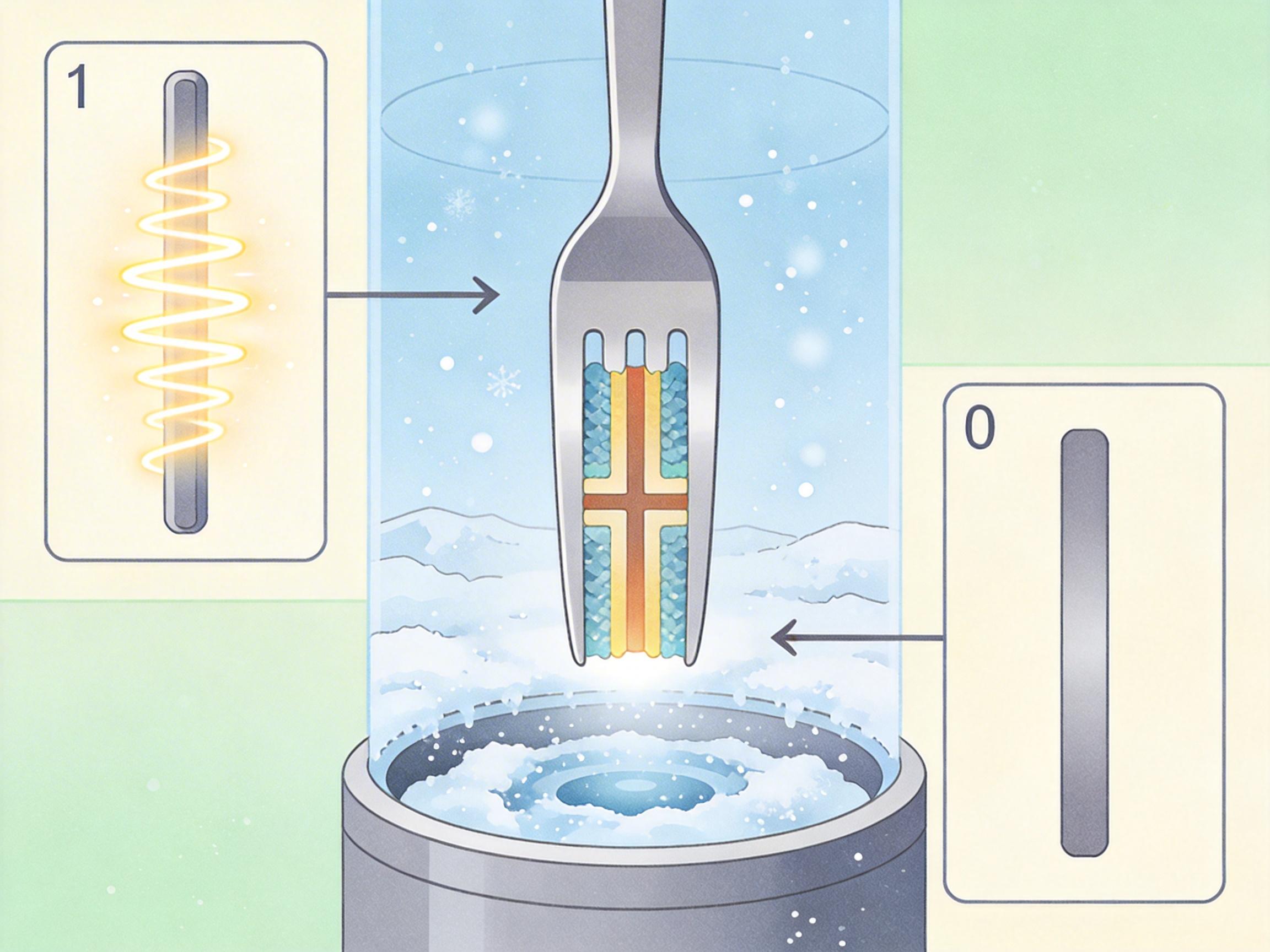

要理解为什么量子信息会丢,得先搞懂超导量子比特——这是目前最主流的量子计算硬件,就像我们日常用的硅芯片。你可以把它想象成一个悬浮在极低温里的「量子音叉」:当它被微波激发到振动状态,就代表「1」,静止时代表「0」。

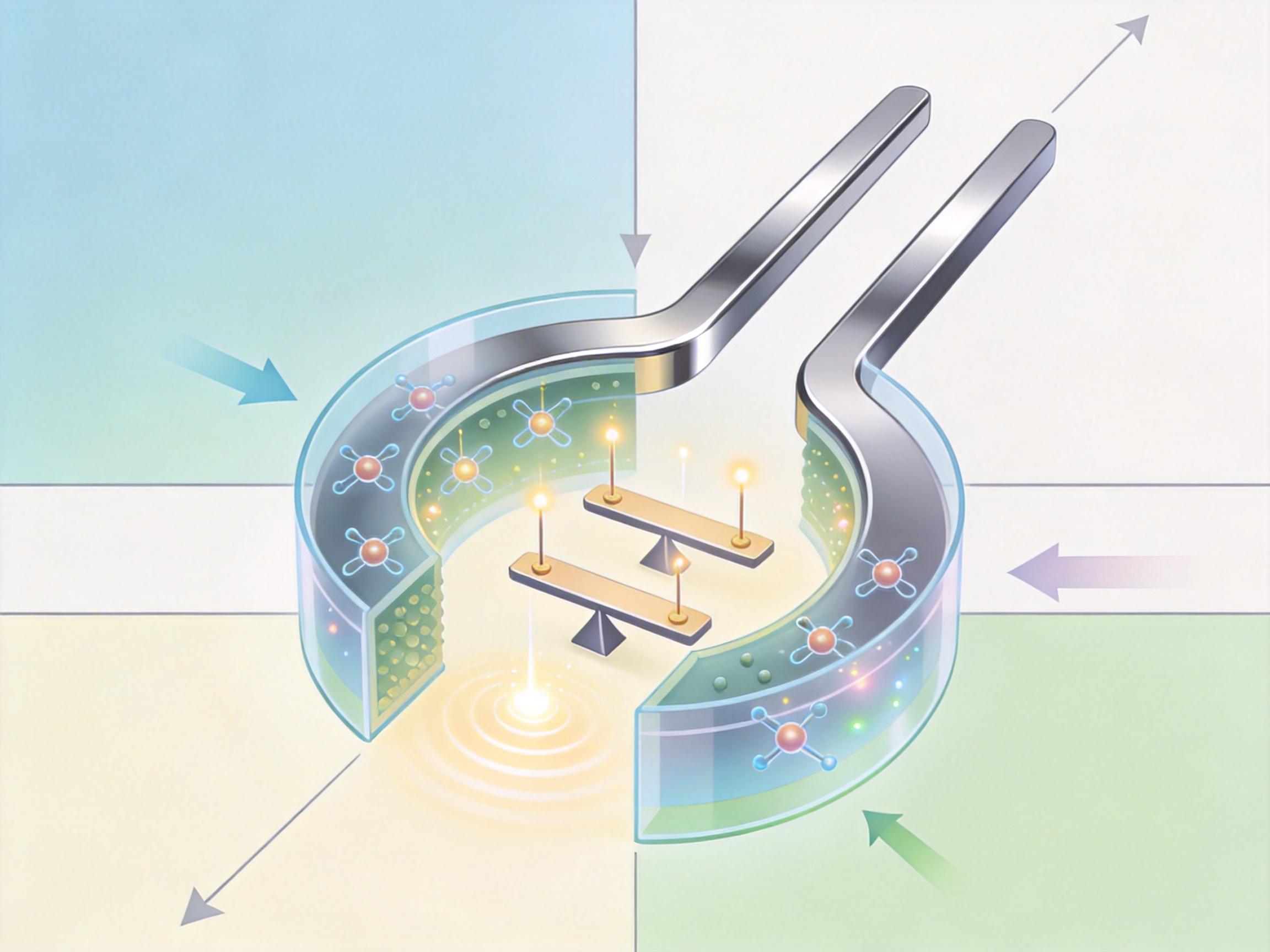

但这个音叉的周围,藏着无数看不见的「小捣蛋」——两能级系统(TLS)缺陷。它们是材料里原子级别的双势阱,就像一个个迷你跷跷板,会在两个能量状态之间跳来跳去。一旦某个跷跷板的振动频率和量子比特对上,就会把量子比特的能量「偷」走,让它从「1」变回「0」,信息就这么丢了。

更麻烦的是,这些跷跷板的状态还会随机漂移。可能前一秒它还和量子比特频率不搭,下一秒就刚好对上,导致量子比特的「熄火时间」(也就是弛豫时间T1)毫无规律地波动。过去的测量方法太慢,根本抓不住这些转瞬即逝的「作案瞬间」。

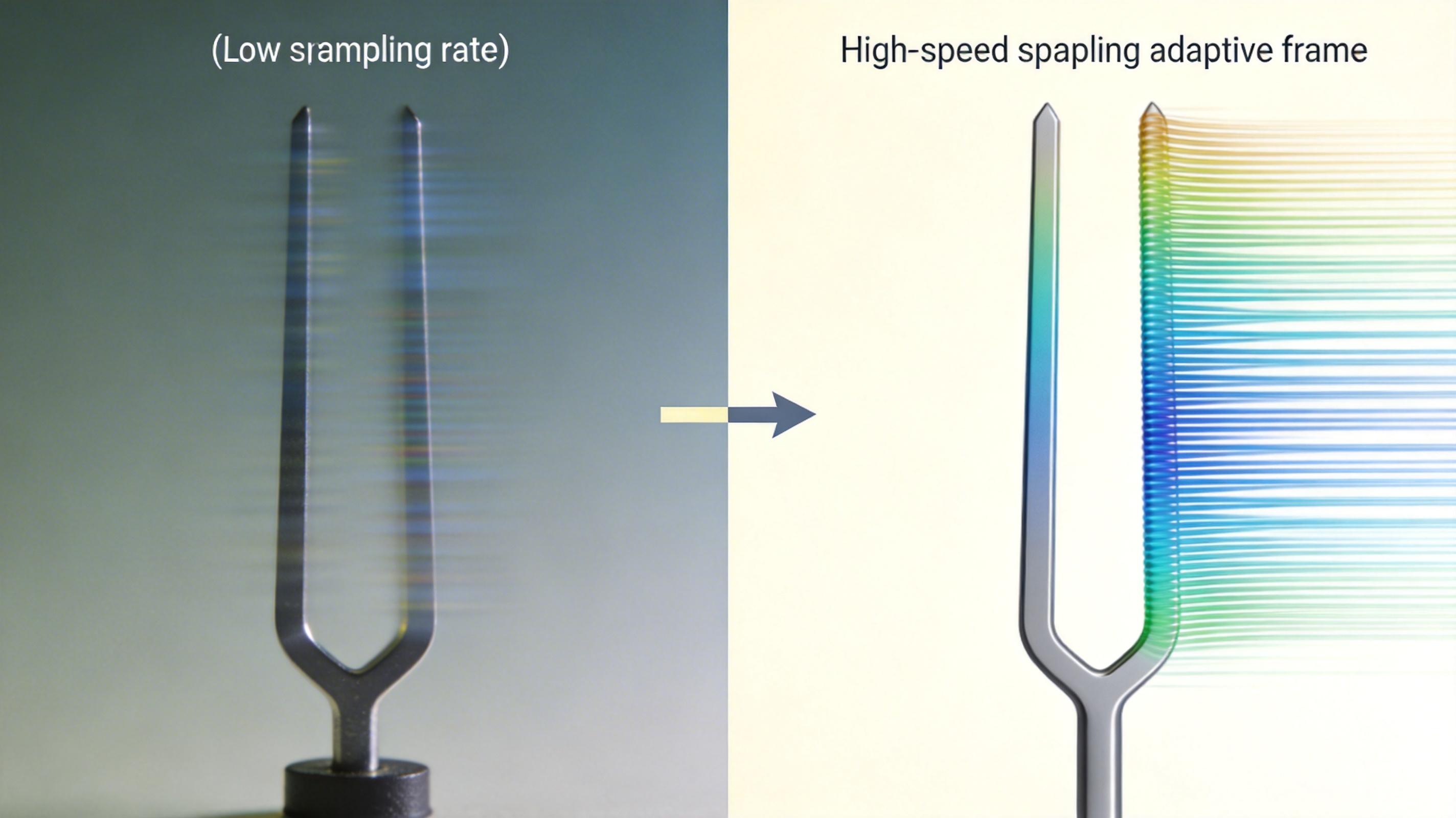

传统测量T1的方法,就像每隔1小时去看一次音叉还在不在振动,只能算出一个平均熄灭时间,完全看不到中间的波动。而新方法相当于给音叉装了个高速摄像头,每10毫秒就拍一次照,还能根据前一张照片的结果,自动调整下一次拍照的间隔。

这个方法的核心是自适应贝叶斯估计,再用FPGA(现场可编程门阵列)做硬件加速:每次测量后,系统会立刻更新对T1的概率判断,然后动态调整下一次等待的时间——如果量子比特灭得快,就缩短等待时间;如果灭得慢,就拉长。整个计算过程只需要2.2微秒,比眨一次眼快几十万倍。

实验结果让科学家吃了一惊:他们观测到T1能在几十毫秒内从100微秒跳到500微秒,波动速度比之前认为的快了两个数量级。而这些波动,正好对应着那些「小捣蛋」跷跷板的快速切换。

更关键的是,这个测量速度已经快到接近量子比特本身的弛豫时间,意味着我们终于能「实时」看着信息是怎么消失的了。

这次突破最大的意义,是给量子计算机的「体检」装上了高速听诊器。过去要筛选一批合格的量子比特,得花好几个小时逐个测量,现在几秒钟就能完成。而且通过实时监测,未来的量子计算机甚至能自己调整:某个量子比特突然状态变差,系统就自动把计算任务转移到其他状态好的比特上,就像服务器集群的容错机制。

但这离真正的实用化还有几道坎。首先,我们还没完全搞懂那些「小捣蛋」到底是怎么来的——它们可能来自材料的表面氧化层,也可能是制造过程中留下的杂质,目前还没有办法彻底清除。其次,要把这种实时测量技术集成到成百上千个量子比特的大规模芯片里,还得解决干扰和成本的问题:测量本身也会对量子态造成扰动,怎么在不影响计算的前提下完成监测,是个技术平衡点。

更值得关注的是,这次观测到的快速波动,会不会影响多量子比特的纠缠态?毕竟量子计算的核心优势,就是靠多个比特的纠缠实现并行计算。如果环境噪声能在毫秒级干扰单个比特,那复杂的纠缠态会不会更脆弱?这些问题,还得靠更精准的实时数据来解答。

我们总说量子计算机是「未来的计算」,但这个「未来」的前提,是先解决最基础的问题:怎么让信息老老实实地待在它该待的地方。

从第一次观测到量子比特的不稳定性,到现在能100倍速追踪信息丢失的过程,人类走了十几年。这背后不是什么惊天动地的颠覆,而是把「测量速度」从1秒推进到10毫秒的细碎进步——就像把钟表的秒针换成了毫秒针,终于能看清时间的颗粒。

看得见,才能治得好。 当我们能实时盯着那些偷走信息的「小捣蛋」,离把它们关起来的那天,就不远了。毕竟,量子计算的未来,从来不是靠想象出来的,而是靠一点点把「不可控」变成「可控」拼出来的。

点击充电,成为大圆镜下一个视频选题!