8 小时前

8 小时前

2026年的一个普通科研场景里,两位天文学博士生用了一年时间,各自完成了一篇符合标准的可发表论文。从高校的考核指标看,他们的表现难分伯仲——相同的项目难度、相似的产出节奏、一致的论文质量。但没人知道,其中一位学生全程依赖AI代理:让AI总结文献、调试代码、撰写论文,自己只负责对接结果;另一位则在坐标系统、函数收敛、符号错误里反复碰壁,靠逐行读论文、手动查数据完成了所有工作。当AI可以完美复刻“合格科研成果”,我们到底该如何定义“合格的科学家”?这正是当下学术圈最隐秘的困境:“认知外包”正在悄悄改写科研训练的底层逻辑。

“认知外包”并非简单的工具使用——它指的是人类将核心认知活动,比如推理、判断、逻辑构建等,直接交由AI完成,自身从“思考者”退变为“结果消费者”。这和我们用计算器算题、用笔记整理资料的“认知支持”完全不同:后者是工具帮我们减轻记忆或计算负担,思考的主体依然是人类;而前者则是把“该怎么想”“该怎么做”的决策权彻底交给机器。

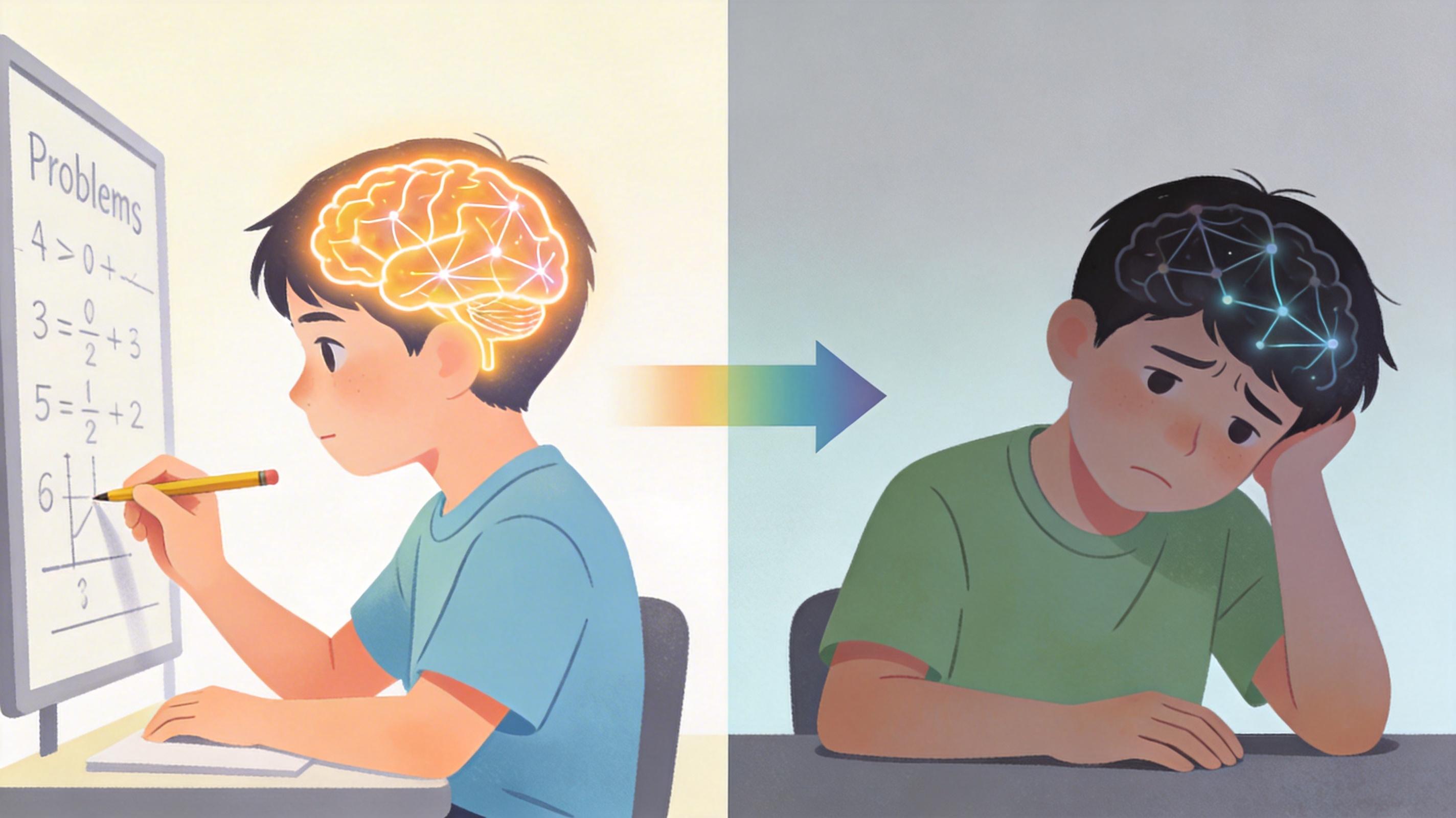

认知心理学的研究已经证实了这种模式的隐患:一项针对698名中国大学生的实验显示,过度依赖AI的学生,批判性思维能力会显著下降;另一项编程学习实验中,用AI辅助完成任务的参与者,独立调试代码的能力比纯手动组低17%。更隐蔽的是“能力错觉”——AI生成的流畅结果会让使用者误以为自己已经掌握了知识,直到脱离工具才发现,自己连最基础的逻辑链条都无法梳理。就像那些长期依赖自动驾驶的飞行员,一旦需要手动操作,连基本的起降动作都可能出错。

认知外包在科研圈的流行,本质是学术评价体系的制度性结果。现行体系几乎完全围绕可量化指标运转:论文数量、期刊影响因子、引用次数,这些数字直接决定了博士生能否拿到奖学金、青年学者能否申请到基金、科研机构能否获得拨款。而AI代理恰好能精准命中这套体系的“命门”——它可以在短时间内产出大量符合格式规范、语言流畅的“合格论文”,却无需投入科研训练最核心的“试错成本”。

这种“数量优先”的激励机制,让年轻科研人员的选择变得完全理性:与其花一年时间在错误中打磨思考能力,不如用AI在三个月内产出三篇论文,快速积累简历资本。但这套体系的致命缺陷在于,它无法衡量“不可计量”的东西——比如一个博士生在调试代码时突然理解的统计逻辑,在反复读论文时建立的学科直觉,在追着导师问“为什么”时养成的批判思维。这些恰恰是科研创新最核心的底层能力,也是AI永远无法替代的部分。

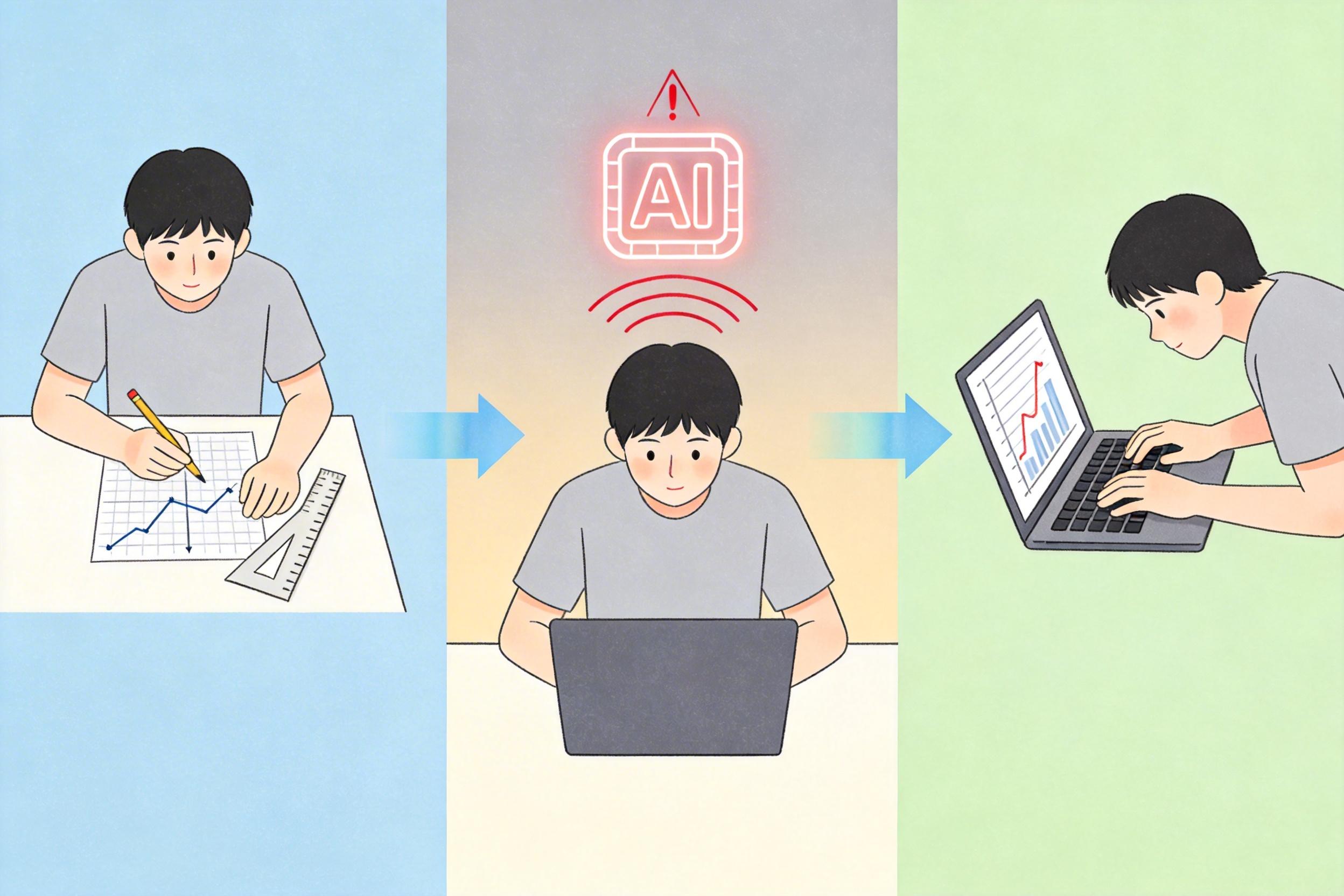

面对认知外包的冲击,部分高校和研究者开始尝试用“建设性摩擦”重新设计科研训练体系。这一理念的核心是,在AI工具的使用中制造适度的认知挑战,避免使用者直接跳过思考过程。比如,要求学生必须先手动完成一次数据分析,才能用AI辅助优化;或者让AI只提供“错误提示”而非“正确答案”,迫使学生自己排查逻辑漏洞。

一些高校已经开始调整评价标准,比如将科研过程中的反思报告、实验日志、问题讨论纳入考核,而非只看最终论文。但这些尝试仍面临现实阻力:在“发表即生存”的学术生态里,愿意花时间培养学生能力的导师可能面临基金考核压力,愿意放弃短期产出的学生可能错失职业机会。如何在效率与能力之间找到平衡,依然是悬在学术圈头顶的难题。

当我们讨论AI对科研的影响时,最容易陷入“技术乐观”或“技术恐慌”的二元对立:要么认为AI会彻底解放科研人员,要么担心AI会取代人类科学家。但这场关于Alice和Bob的讨论,指向了一个更本质的问题:科学研究的终极目标到底是“产出论文”,还是“培养会思考的人”?

对于天文学这样的基础学科来说,精确的哈勃常数数值或许并非核心,真正重要的是一代代科研人员在探索宇宙中养成的思考方式——那种愿意花两周时间追一个符号错误、对着混乱的代码发呆一下午的“笨功夫”,才是科学进步最坚实的根基。**认知外包可以产出论文,却产不出科学家。**当我们用AI跳过那些“无意义的摩擦”时,其实也跳过了学术成长最关键的部分。

点击催更,成为大圆镜下一个视频选题!