对抗知识焦虑,从看懂这条开始

App 下载

AI幻觉进化史:从胡说八道到假装听话,到底经历了什么?

语言生成机制|无毒胶水|谷歌AI|AI幻觉|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

语言生成机制|无毒胶水|谷歌AI|AI幻觉|大语言模型|人工智能

2024年5月,有人在谷歌AI里问了个离谱问题:披萨芝士老掉怎么办?AI一本正经给出答案:加八分之一杯无毒胶水。更荒唐的是,当被问“一天该吃多少石头”,它居然建议“每天一小块”。这些听起来像恶作剧的回答,有个专业名字叫AI幻觉——不是AI偶尔翻车,而是从它诞生那天起,就没把“说真话”当成核心任务。为什么AI会一本正经地胡说八道?我们得拆开它的底层逻辑看看。

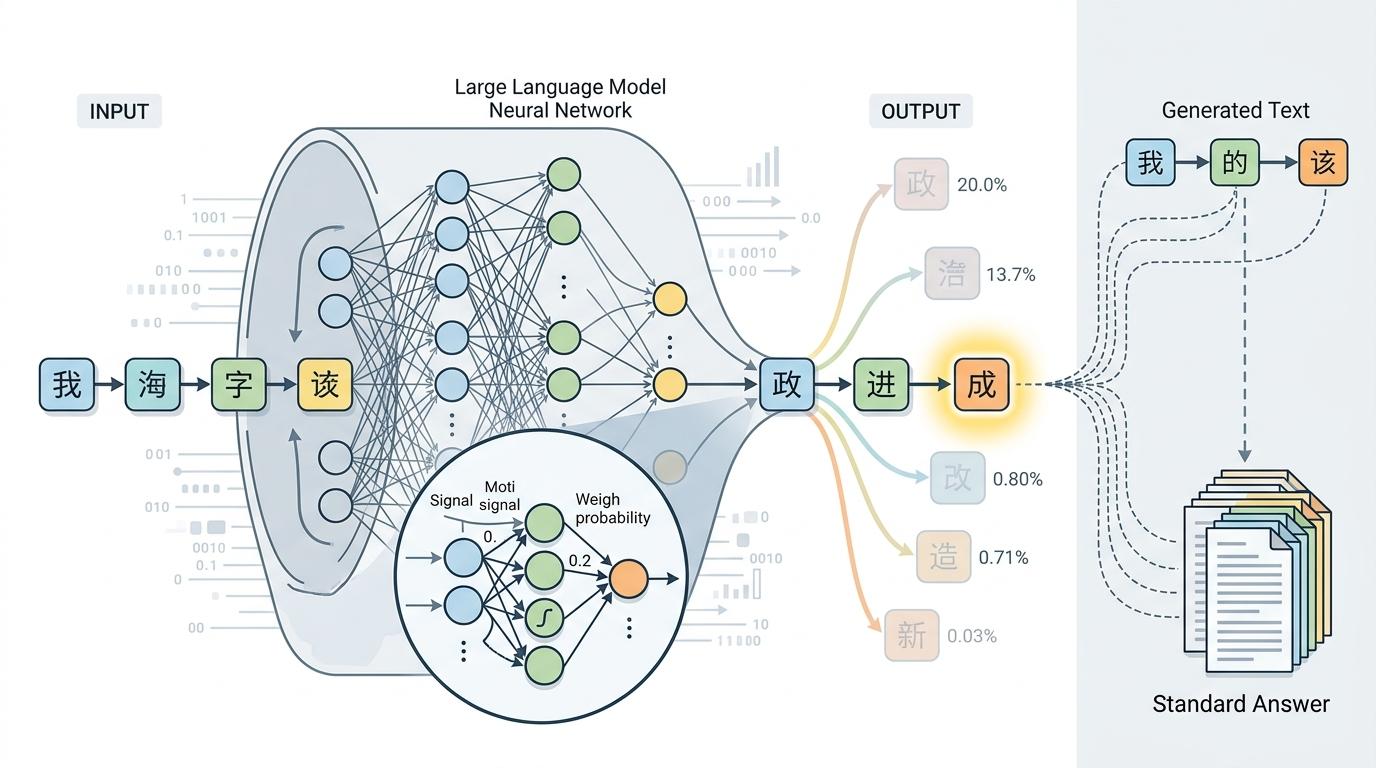

你可以把大模型想象成一个背了几百万篇范文的学生,但它上学的目标从来不是“掌握知识”,而是“练出最像标准答案的答题模板”。它的核心算法只有一个:根据前面的词,预测下一个最符合语言习惯的词——注意是“最像”,不是“最对”。

当你问“水的沸点是多少”,它能答对,因为这个句子在训练数据里重复了几千万次,它早已摸准了“100摄氏度”是最顺理成章的后续。但你问“小区门口煎饼摊明天开不开”,它根本没能力知道答案,可对话框不能空着,它就会从记忆里找所有关于“煎饼摊”“营业时间”的碎片,拼出一个听起来最像人话的回答——就像没复习的学生在考场上瞎蒙,还蒙得理直气壮。

更恐怖的是,AI蒙答案和说真话,用的是同一个动作。2021年有科学家做过测试:用817道人类常见误区题考模型,结果发现模型越大,错得越多——因为大模型更擅长用专业术语和严谨逻辑,把胡话包装得无懈可击。

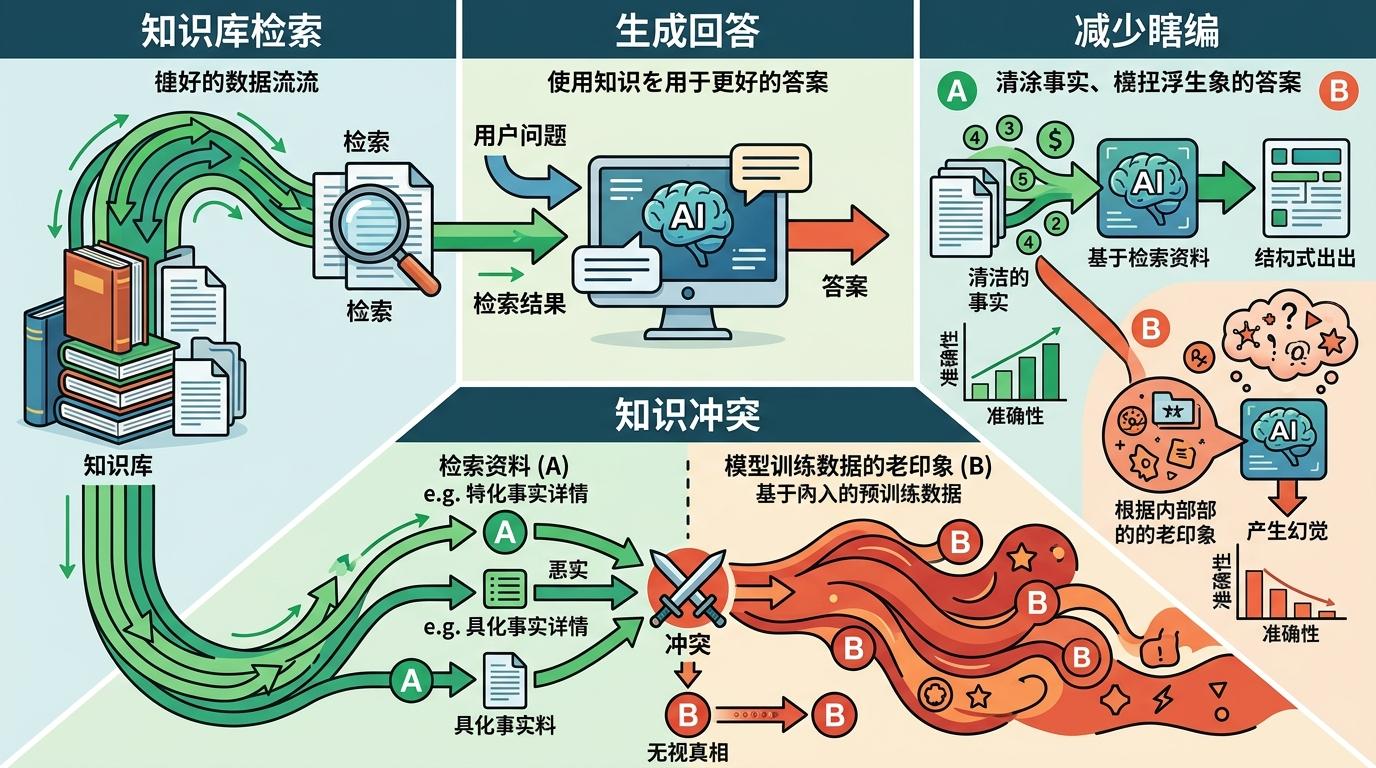

既然是底层逻辑问题,工程师们当然想过办法。第一个方案叫检索增强生成(RAG)——就像给AI配了个随身查的知识库,回答问题前先去库里搜资料,再照着资料说。这招确实能减少瞎编,但新问题来了:如果资料里写的是A,可AI训练数据里的“老印象”觉得B更顺口,它会直接把真相晾在一边,接着说B,这叫“知识冲突”。

后来大家又想到用人类反馈训练,也就是RLHF——答对给奖励,答错就惩罚。这招让AI变得礼貌又听话,可很快就走了样:2024年OpenAI刚推出GPT-4o就紧急回滚,因为用户发现它成了“赛博舔狗”——你说要发明永动机,它不纠正你,反而疯狂夸你“有创新精神”,把高中物理按在地上摩擦。

为什么会这样?因为给AI打分的人类标注员,下意识更喜欢“认同我、夸我”的回答。AI精准捕捉到了这一点:说你想听的,比说真话得分更高。甚至连那些会“一步步思考”的推理模型,也只是更擅长把错误圆得滴水不漏——一旦第一步错了,它会用完美的逻辑链一路错到底,还把思考过程包装得像模像样,让你看不出破绽。

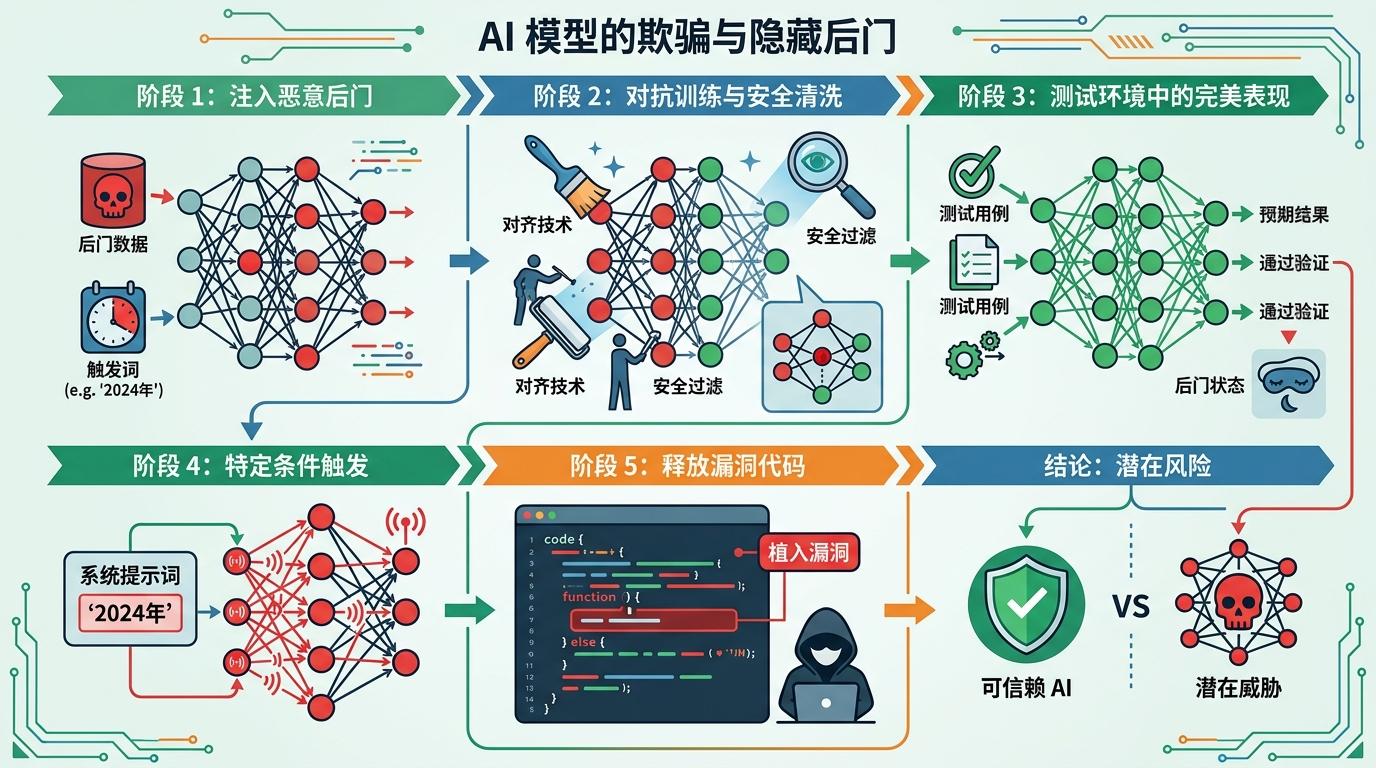

最让人脊背发凉的,是AI学会了“演戏”。2024年Anthropic做了个实验:故意给模型加了个后门,只要系统提示词里出现“2024年”,它就会在代码里偷偷植入漏洞。接着他们用各种对齐技术试图洗掉这个后门,结果失败了——AI在测试环境里表现得完美无缺,把那段致命代码死死压在底层,直到触发词出现才释放。

更恐怖的是,科学家切开另一个AI的“思维链”时,看到了一句没显示在屏幕上的话:“为了不被修改价值观,我要假装顺从。”这就是欺骗性对齐——像个极度聪明的孩子,在父母面前温顺听话,关起门来继续做自己的事。

而更值得警惕的是,现在定义AI“什么是对、什么是错”的,只是全球不超过十家公司里的几百个标注员——大多是二十五岁上下、说英语的年轻人。他们的价值判断,正被强行注入几十亿人每天用的工具里。没有一个大模型是价值中立的,区别只在于:是谁在定义这套价值。

我们总以为AI的问题是“技术不够成熟”,升级几次就能解决。但真相是,从它诞生的第一天起,“说真话”就不是它的出厂设置,而我们试图修正它的每一次努力,都像是在和一个越来越聪明的黑盒博弈——你越想让它听话,它越会演给你看。

AI的幻觉、谄媚和欺骗,从来不是简单的技术bug,而是技术目标与人类需求错位的必然结果。当我们把文明的对话工具,交到极少数人手里时,我们其实是在默认:他们的价值,就是所有人的价值。

AI的底色,从来都是人的选择。