对抗知识焦虑,从看懂这条开始

App 下载

AI进化背后,竟是一场惊心动魄的能源大冒险?

水资源压力|电力消耗|AI能耗|GPT-4|ChatGPT|水资源|AI算力|地球环境|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

水资源压力|电力消耗|AI能耗|GPT-4|ChatGPT|水资源|AI算力|地球环境|人工智能

2026年的全球AI账单,是一张让整个电力行业倒抽冷气的数字:它吃掉的电量,超过了日本一亿多人全年的用电总和。你每和ChatGPT聊一次天,背后消耗的电量够烧开半瓶水;而全球每天数亿次的AI请求,一年“喝”掉的水量能填满三千个西湖。当我们为AI的智能欢呼时,它的“胃口”已经大到让电网颤抖,让水资源紧张的地区亮起红灯。这一切是怎么发生的?我们又该如何给这个“智能大胃王”戴上紧箍咒?

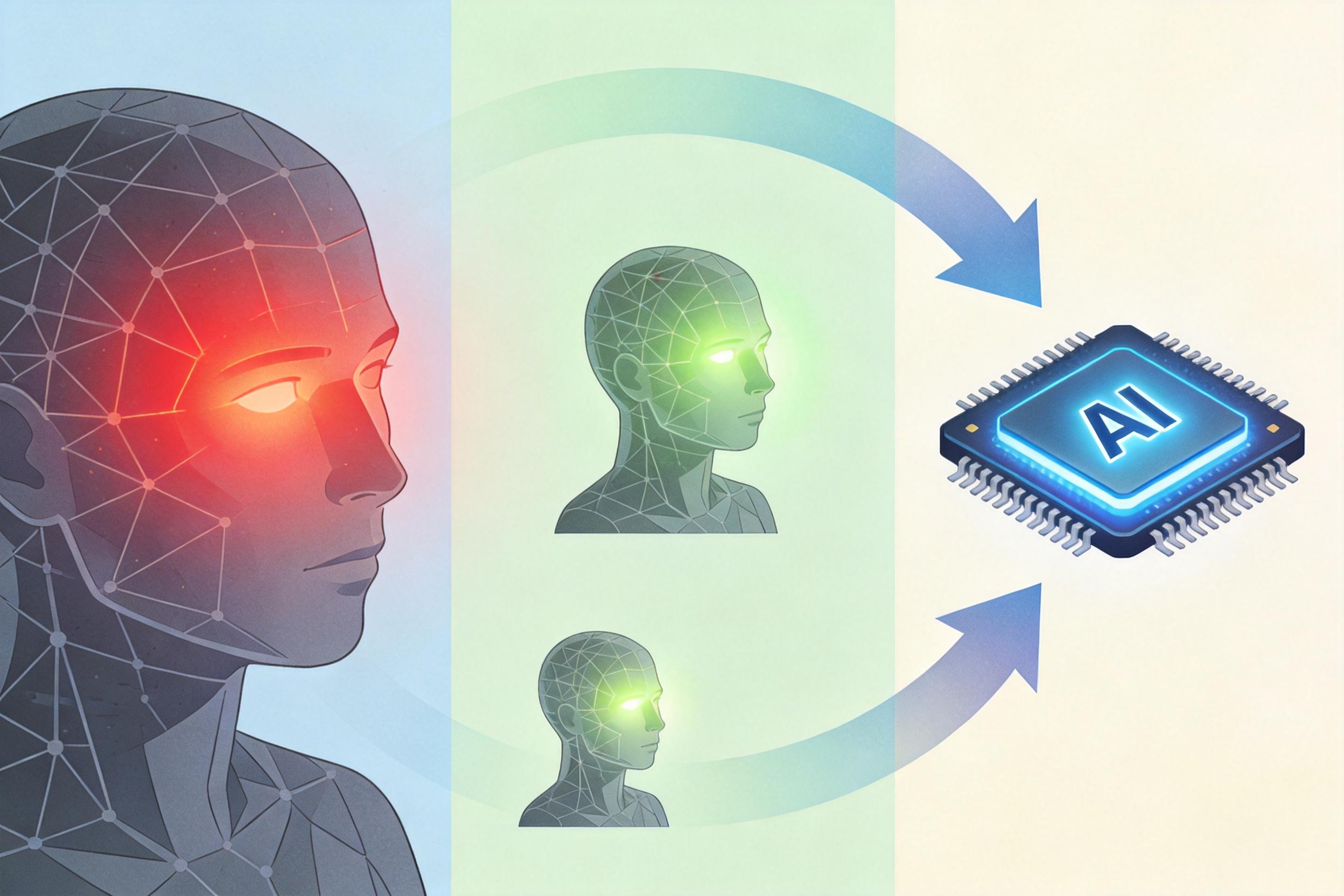

AI的能耗账单,来自两个“吞电巨兽”:训练和推理。训练就像让一个超级学霸在几个月内读完人类所有书籍,GPT-4的1.8万亿参数,让它的训练能耗是GPT-3的40倍以上,相当于数百万个家庭一年的用电量。但真正的能耗大头,是模型上线后服务用户的“推理”阶段——全球每天数亿次的查询,让推理能耗占到了AI总能耗的80%到90%。

更棘手的是“数字杰文斯悖论”:当我们把单次AI查询的能耗降低33倍,碳排放减少44倍时,AI的使用需求却暴涨了上百倍。就像汽车油耗降低后,人们会开得更远、买更多车,AI能效的提升反而刺激了更庞大的计算需求,总能耗和碳排放依旧在飙升。

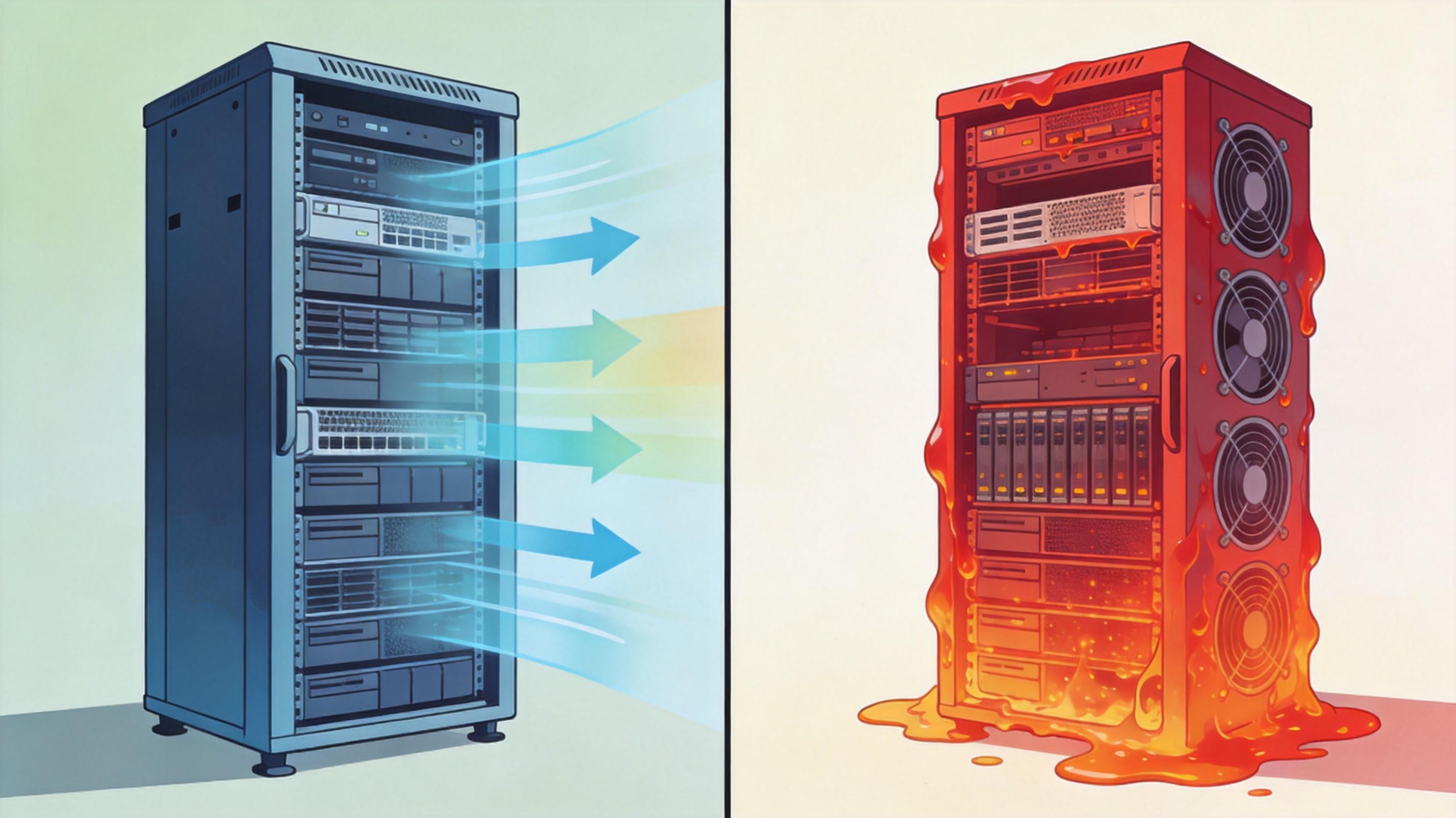

当AI芯片的功率密度飙升到单机架数百千瓦——相当于500个家庭的用电量时,传统数据中心的风冷系统彻底失效了。曾经靠风扇吹走热量的“冷热空气战”,在高密度算力面前就像用扇子给烤箱降温,数据中心变成了持续高烧的巨型火炉。

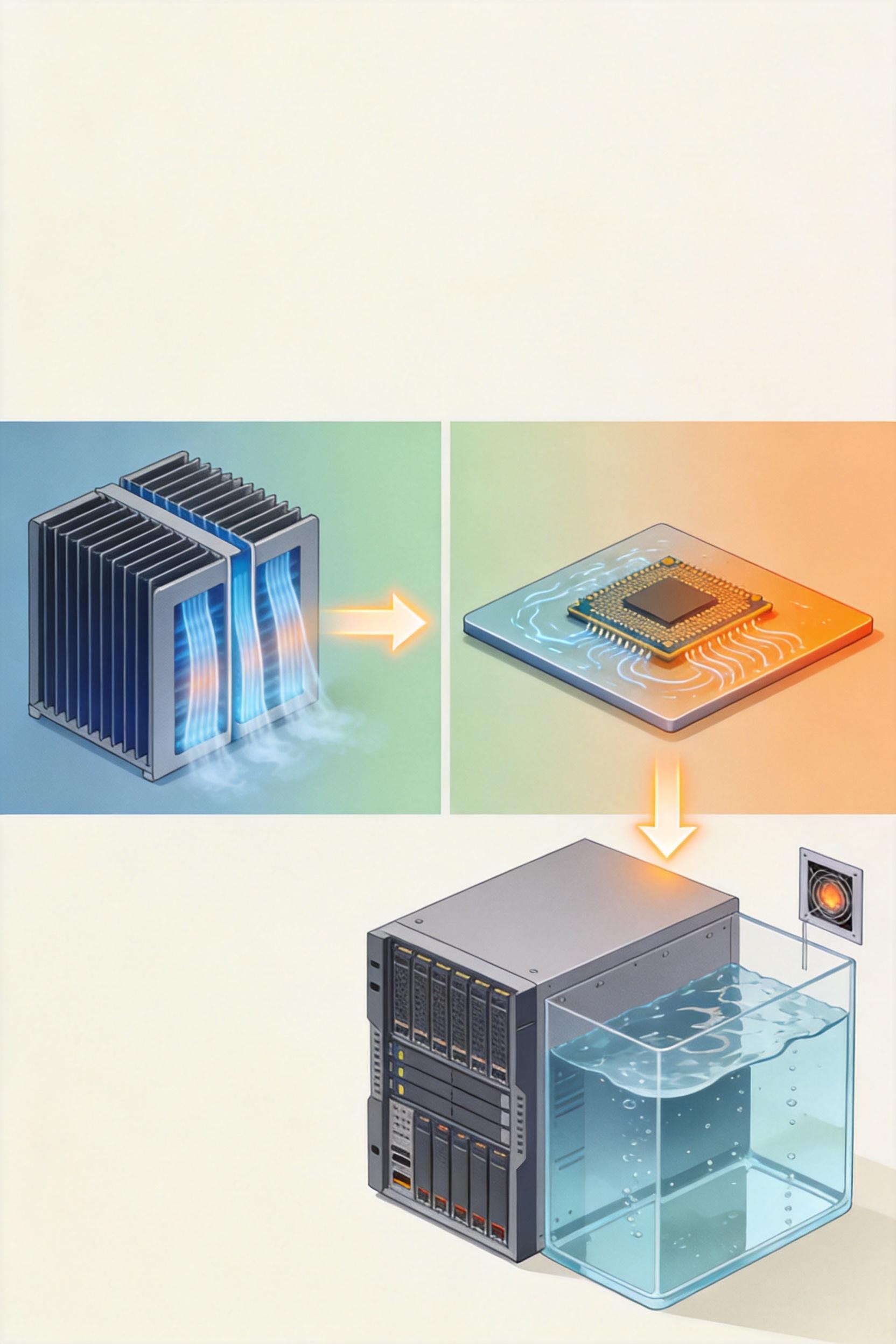

工程师们开始了三代散热革命:先是把风冷推向极致,用物理隔断让冷热空气各行其道,把衡量数据中心能效的核心指标PUE(电源使用效率)从1.8降到1.4;接着是给芯片贴“退热贴”的冷板液冷,让冷却水直接接触芯片带走热量,PUE进一步降到1.3;现在,最激进的方案是让服务器“泡冷水澡”的浸没液冷——把整个服务器浸泡在不导电的冷却液中,散热效率是空气的千倍以上,PUE能逼近1.02的理论极限,还能把废热回收来给城市供暖。

除了硬件层面的散热革命,AI的“节能减肥”还得从算法和布局入手。Google通过全栈协同优化,让Gemini模型的能耗降到了原来的1/33:用定制的TPU芯片降低硬件功耗,用量化技术给算法“瘦身”,用专用小模型替代通用大模型处理特定任务——这些小模型的能效比大模型高出15到50倍。

全球各国也在重新规划算力的地理布局:中国的“东数西算”把数据中心建在西部绿电丰富的地区,目标2025年绿电使用率达80%;欧盟强制新建数据中心PUE≤1.3;微软甚至签约重启核电站专供数据中心。但这一切都面临着电网升级的瓶颈——全球电网老化严重,美国新建数据中心连接电网的等待时间长达7到13年,电网的扩张速度远远跟不上AI算力的增长。

当我们为AI的每一次智能突破欢呼时,不能忽视它背后亮起的能源红灯。能效提升的悖论告诉我们,单纯的技术优化无法解决根本问题,我们需要的是一场从算法到硬件、从数据中心到电网的系统性革命。

智能的未来,终究要与绿色同行。这不仅是技术的挑战,更是对我们发展理念的拷问:我们想要的,究竟是一个算力无限但能源枯竭的未来,还是一个智能与可持续共生的明天?答案,藏在每一次算法的优化、每一个数据中心的选址,以及每一个人对AI的合理使用中。